жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ

дёӢж–Үз»ҷеӨ§е®¶еёҰжқҘе®һзҺ°keepalivedеҸҢдё»жЁЎеһӢlvsй«ҳеҸҜз”ЁйӣҶзҫӨзҡ„е®һйӘҢжҖ»з»“пјҢеёҢжңӣиғҪеӨҹз»ҷеӨ§е®¶еңЁе®һйҷ…иҝҗз”ЁдёӯеёҰжқҘдёҖе®ҡзҡ„её®еҠ©пјҢиҙҹиҪҪеқҮиЎЎж¶үеҸҠзҡ„дёңиҘҝжҜ”иҫғеӨҡпјҢзҗҶи®әд№ҹдёҚеӨҡпјҢзҪ‘дёҠжңүеҫҲеӨҡд№ҰзұҚпјҢд»ҠеӨ©жҲ‘们е°ұз”ЁдәҝйҖҹдә‘еңЁиЎҢдёҡеҶ…зҙҜи®Ўзҡ„з»ҸйӘҢжқҘеҒҡдёҖдёӘи§Јзӯ”гҖӮ

е®һзҺ°keepalivedеҸҢдё»жЁЎеһӢlvsй«ҳеҸҜз”ЁйӣҶзҫӨ

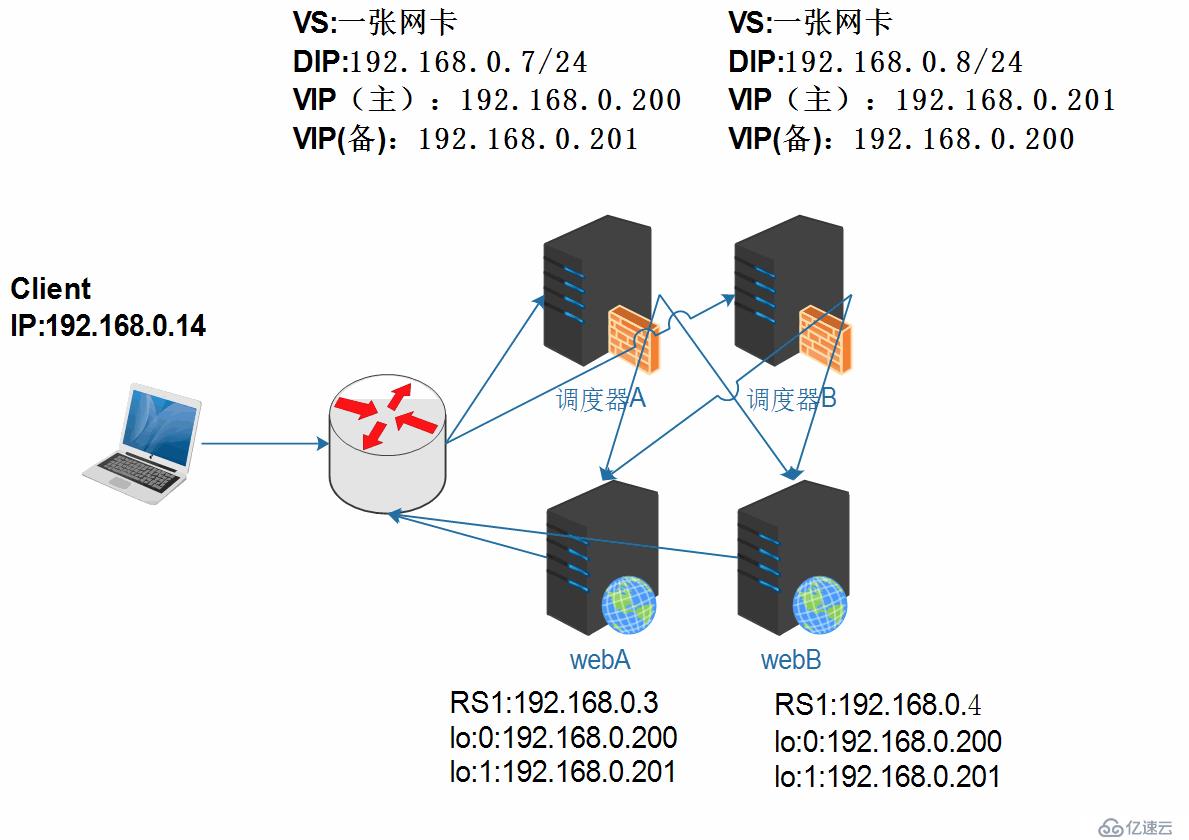

дёҖгҖҒжӢ“жү‘еӣҫ

дәҢгҖҒзҺҜеўғеҮҶеӨҮ

дёӨеҸ°иҙҹиҪҪеқҮиЎЎи°ғеәҰеҷЁпјҢдёӨеҸ°webдә‘жңҚеҠЎеҷЁгҖӮ

и°ғеәҰеҷЁAзҺҜеўғ:

VS:дёҖеј зҪ‘еҚЎ

DIP:192.168.0.7/24

VIPпјҲдё»пјүпјҡ192.168.0.200

VIP(еӨҮ)пјҡ192.168.0.201

иҪҜ件еҢ…пјҡyum install -y keepalived ipvsadm nginx(дҪңз”Ёпјҡsorry-serverжңҚеҠЎ)

и°ғеәҰеҷЁBзҺҜеўғпјҡ

VS:дёҖеј зҪ‘еҚЎ

DIP:192.168.0.8/24

VIPпјҲдё»пјүпјҡ192.168.0.201

VIP(еӨҮ)пјҡ192.168.0.200

иҪҜ件еҢ…пјҡyum install -y keepalived ipvsadm nginx(дҪңз”Ёпјҡsorry-serverжңҚеҠЎ)

webжңҚеҠЎеҷЁAзҺҜеўғпјҡ

RS1:192.168.0.3

lo:0:192.168.0.200

lo:1:192.168.0.201

иҪҜ件еҢ…пјҡyum install -y httpd

webжңҚеҠЎеҷЁBзҺҜеўғпјҡ

RS1:192.168.0.4

lo:0:192.168.0.200

lo:1:192.168.0.201

иҪҜ件еҢ…пјҡyum install -y httpd

дёүгҖҒй…ҚзҪ®

и°ғеәҰеҷЁAй…ҚзҪ®

дё»иҰҒж“ҚдҪңпјҡipй…ҚзҪ®пјҢж—¶й—ҙеҗҢжӯҘгҖҒhostsж–Ү件жӣҙж”№пјҢдҝ®ж”№дё»жңәеҗҚпјҲзЎ®дҝқдё»д»ҺиҠӮзӮ№иғҪеӨҹйҖҡдҝЎпјүгҖҒkeepalived.confй…ҚзҪ®ж–Ү件жӣҙж”№пјҢйҖҡзҹҘи„ҡжң¬й…ҚзҪ®(дёӨдёӘи„ҡжң¬)пјҢipvsadm规еҲҷжҹҘзңӢ

ipй…ҚзҪ®

[root@node1keepalived]# ip a 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000 link/ether 00:0c:29:0c:d2:06 brd ff:ff:ff:ff:ff:ff inet 192.168.0.7/24 brd 192.168.0.255 scope global ens33 valid_lft forever preferred_lft forever inet 192.168.0.200/24 scope global secondary ens33:1 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:fe0c:d206/64 scope link valid_lft forever preferred_lft forever

ж—¶й—ҙеҗҢжӯҘ

ntpdate ntp-server-ip #ж—¶й—ҙжңҚеҠЎеҷЁзҡ„ip

hostsж–Ү件

[root@node1 keepalived]# cat /etc/hosts 127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 node1 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 node1 192.168.0.8 node2 192.168.0.7 node1

дё»жңәеҗҚдҝ®ж”№

hostnamectl set-hostname node1

keepalived.confй…ҚзҪ®ж–Ү件жӣҙж”№

[root@localhost keepalived]# cat keepalived.conf

! Configuration File for keepalived

global_defs {

notification_email {

root@localhost

}

notification_email_from keepalived@localhost

smtp_server 127.0.0.1

smtp_connect_timeout 10

router_id node1

vrrp_mcast_group4 224.0.0.223

}

vrrp_instance VI_1 {

state MASTER

interface ens33

virtual_router_id 51

priority 110

advert_int 1

authentication {

auth_type PASS

auth_pass JzvnmfkY

}

virtual_ipaddress {

192.168.0.200/24 dev ens33 label ens33:1

}

notify_master "/etc/keepalived/notify1.sh master"

notify_backup "/etc/keepalived/notify1.sh backup"

notify_fault "/etc/keepalived/notify1.sh fault"

}

virtual_server 192.168.0.200 80 {

delay_loop 3

lb_algo wrr

lb_kind DR

protocol TCP

sorry_server 127.0.0.1 80

real_server 192.168.0.3 80 {

weight 2

HTTP_GET {

url {

path /

status_code 200

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

real_server 192.168.0.4 80 {

weight 1

HTTP_GET {

url {

path /

status_code 200

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

}

vrrp_instance VI_2 {

state BACKUP

interface ens33

virtual_router_id 52

priority 90

advert_int 1

authentication {

auth_type PASS

auth_pass JzvnmfkY

}

virtual_ipaddress {

192.168.0.201/24 dev ens33 label ens33:2

}

notify_master "/etc/keepalived/notify2.sh master"

notify_backup "/etc/keepalived/notify2.sh backup"

notify_fault "/etc/keepalived/notify2.sh fault"

}

virtual_server 192.168.0.201 80 {

delay_loop 3

lb_algo wrr

lb_kind DR

protocol TCP

sorry_server 127.0.0.1 80

real_server 192.168.0.3 80 {

weight 1

HTTP_GET {

url {

path /

status_code 200

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

real_server 192.168.0.4 80 {

weight 2

HTTP_GET {

url {

path /

status_code 200

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

}йҖҡзҹҘи„ҡжң¬й…ҚзҪ®

и„ҡжң¬1

[root@node1 keepalived]# cat notify1.sh

#!/bin/bash

#description: An example of notify script

#

vip=192.168.0.200

contact='root@localhost'

notify(){

local mailsubject="$(hostname) to be $1:$vip floating"

local mailbody="$(date +'%F %T'):vrrp1 transition,$(hostname) changed to be $1"

echo "$mailbody" | mail -s "$mailsubject" $contact

}

case $1 in

master)

notify master

;;

backup)

notify backup

;;

fault)

notify fault

;;

*)

echo "Usage:$(basename $0) {master|backup|fault}"

exit 1

;;

esacи„ҡжң¬2

[root@node1 keepalived]# cat notify2.sh

#!/bin/bash

#description: An example of notify script

#

vip=192.168.0.201

contact='root@localhost'

notify(){

local mailsubject="$(hostname) to be $1:$vip floating"

local mailbody="$(date +'%F %T'):vrrp2 transition,$(hostname) changed to be $1"

echo "$mailbody" | mail -s "$mailsubject" $contact

}

case $1 in

master)

notify master

;;

backup)

notify backup

;;

fault)

notify fault

;;

*)

echo "Usage:$(basename $0) {master|backup|fault}"

exit 1

;;

esacipvsadm规еҲҷжҹҘзңӢ

[root@node1 keepalived]# ipvsadm -ln IP Virtual Server version 1.2.1 (size=4096) Prot LocalAddress:Port Scheduler Flags -> RemoteAddress:Port Forward Weight ActiveConn InActConn TCP 192.168.0.200:80 wrr -> 192.168.0.3:80 Route 2 0 0 -> 192.168.0.4:80 Route 1 0 0 TCP 192.168.0.201:80 wrr -> 192.168.0.3:80 Route 1 0 0 -> 192.168.0.4:80 Route 2 0 0

и°ғеәҰеҷЁBй…ҚзҪ®

дё»иҰҒж“ҚдҪңпјҡipй…ҚзҪ®пјҢж—¶й—ҙеҗҢжӯҘгҖҒhostsж–Ү件жӣҙж”№пјҢдҝ®ж”№дё»жңәеҗҚпјҲзЎ®дҝқдё»д»ҺиҠӮзӮ№иғҪеӨҹйҖҡдҝЎпјүгҖҒkeepalived.confй…ҚзҪ®ж–Ү件жӣҙж”№пјҢйҖҡзҹҘи„ҡжң¬й…ҚзҪ®(дёӨдёӘи„ҡжң¬)пјҢipvsadm规еҲҷжҹҘзңӢ

ipй…ҚзҪ®

[root@node2 keepalived]# ip a 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000 link/ether 00:0c:29:3f:e3:9e brd ff:ff:ff:ff:ff:ff inet 192.168.0.8/24 brd 192.168.0.255 scope global ens33 valid_lft forever preferred_lft forever inet 192.168.0.201/24 scope global secondary ens33:2 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:fe3f:e39e/64 scope link valid_lft forever preferred_lft forever

ж—¶й—ҙеҗҢжӯҘ

ntpdate ntp-server-ip

hostsж–Ү件жӣҙж”№

[root@node2 keepalived]# cat /etc/hosts 127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 node2 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 node2 192.168.0.7 node1 192.168.0.8 node2

дё»жңәеҗҚдҝ®ж”№

hostnamectl set-hostname node2

keepalived.confй…ҚзҪ®ж–Ү件жӣҙж”№

[root@localhost keepalived]# cat keepalived.conf

! Configuration File for keepalived

global_defs {

notification_email {

root@localhost

}

notification_email_from keepalived@localhost

smtp_server 127.0.0.1

smtp_connect_timeout 10

router_id node2

vrrp_mcast_group4 224.0.0.223

}

vrrp_instance VI_1 {

state BACKUP

interface ens33

virtual_router_id 51

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass JzvnmfkY

}

virtual_ipaddress {

192.168.0.200/24 dev ens33 label ens33:1

}

notify_master "/etc/keepalived/notify1.sh master"

notify_backup "/etc/keepalived/notify1.sh backup"

notify_fault "/etc/keepalived/notify1.sh fault"

}

virtual_server 192.168.0.200 80 {

delay_loop 3

lb_algo wrr

lb_kind DR

protocol TCP

sorry_server 127.0.0.1 80

real_server 192.168.0.3 80 {

weight 2

HTTP_GET {

url {

path /

status_code 200

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

real_server 192.168.0.4 80 {

weight 1

HTTP_GET {

url {

path /

status_code 200

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

}

vrrp_instance VI_2 {

state MASTER

interface ens33

virtual_router_id 52

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass JzvnmfkY

}

virtual_ipaddress {

192.168.0.201/24 dev ens33 label ens33:2

}

notify_master "/etc/keepalived/notify2.sh master"

notify_backup "/etc/keepalived/notify2.sh backup"

notify_fault "/etc/keepalived/notify2.sh fault"

}

virtual_server 192.168.0.201 80 {

delay_loop 3

lb_algo wrr

lb_kind DR

protocol TCP

sorry_server 127.0.0.1 80

real_server 192.168.0.3 80 {

weight 1

HTTP_GET {

url {

path /

status_code 200

}

status_code 200

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

real_server 192.168.0.4 80 {

weight 2

HTTP_GET {

url {

path /

status_code 200

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

}йҖҡзҹҘи„ҡжң¬й…ҚзҪ®(еҗҢи°ғеәҰеҷЁAзҡ„и„ҡжң¬дёҖиҮҙ)

и„ҡжң¬1

[root@node2 keepalived]# cat notify1.sh

#!/bin/bash

#description: An example of notify script

#

vip=192.168.0.200

contact='root@localhost'

notify(){

local mailsubject="$(hostname) to be $1:$vip floating"

local mailbody="$(date +'%F %T'):vrrp1 transition,$(hostname) changed to be $1"

echo "$mailbody" | mail -s "$mailsubject" $contact

}

case $1 in

master)

notify master

;;

backup)

notify backup

;;

fault)

notify fault

;;

*)

echo "Usage:$(basename $0) {master|backup|fault}"

exit 1

;;

esacи„ҡжң¬2

[root@node2 keepalived]# cat notify2.sh

#!/bin/bash

#description: An example of notify script

#

vip=192.168.0.201

contact='root@localhost'

notify(){

local mailsubject="$(hostname) to be $1:$vip floating"

local mailbody="$(date +'%F %T'):vrrp2 transition,$(hostname) changed to be $1"

echo "$mailbody" | mail -s "$mailsubject" $contact

}

case $1 in

master)

notify master

;;

backup)

notify backup

;;

fault)

notify fault

;;

*)

echo "Usage:$(basename $0) {master|backup|fault}"

exit 1

;;

esacwebжңҚеҠЎеҷЁAй…ҚзҪ®

ipй…ҚзҪ®

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet 192.168.0.201/32 brd 192.168.0.201 scope global lo:1 valid_lft forever preferred_lft forever inet 192.168.0.200/32 brd 192.168.0.200 scope global lo:0 valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000 link/ether 00:0c:29:ab:50:14 brd ff:ff:ff:ff:ff:ff inet 192.168.0.4/24 brd 192.168.0.255 scope global ens33 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:feab:5014/64 scope link valid_lft forever preferred_lft forever

lvs-dr-йў„й…ҚзҪ®и„ҡжң¬

и„ҡжң¬1

[root@localhost ~]# cat vip200-setrs.sh #!/bin/bash # vip=192.168.0.200 mask='255.255.255.255' case $1 in start) echo 1 > /proc/sys/net/ipv4/conf/all/arp_ignore echo 1 > /proc/sys/net/ipv4/conf/lo/arp_ignore echo 2 > /proc/sys/net/ipv4/conf/all/arp_announce echo 2 > /proc/sys/net/ipv4/conf/lo/arp_announce ifconfig lo:0 $vip netmask $mask broadcast $vip up route add -host $vip dev lo:0 ;; stop) ifconfig lo:0 down echo 0 > /proc/sys/net/ipv4/conf/all/arp_ignore echo 0 > /proc/sys/net/ipv4/conf/lo/arp_ignore echo 0 > /proc/sys/net/ipv4/conf/all/arp_announce echo 0 > /proc/sys/net/ipv4/conf/lo/arp_announce ;; *) echo "Usage $(basename $0) start|stop" exit 1 ;; esac

и„ҡжң¬2

[root@localhost ~]# cat vip201-setrs.sh #!/bin/bash # vip=192.168.0.201 mask='255.255.255.255' case $1 in start) echo 1 > /proc/sys/net/ipv4/conf/all/arp_ignore echo 1 > /proc/sys/net/ipv4/conf/lo/arp_ignore echo 2 > /proc/sys/net/ipv4/conf/all/arp_announce echo 2 > /proc/sys/net/ipv4/conf/lo/arp_announce ifconfig lo:1 $vip netmask $mask broadcast $vip up route add -host $vip dev lo:1 ;; stop) ifconfig lo:1 down echo 0 > /proc/sys/net/ipv4/conf/all/arp_ignore echo 0 > /proc/sys/net/ipv4/conf/lo/arp_ignore echo 0 > /proc/sys/net/ipv4/conf/all/arp_announce echo 0 > /proc/sys/net/ipv4/conf/lo/arp_announce ;; *) echo "Usage $(basename $0) start|stop" exit 1 ;; esac

webжңҚеҠЎеҷЁBй…ҚзҪ®

ipй…ҚзҪ®

[root@localhost ~]# ip a 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet 192.168.0.201/32 brd 192.168.0.201 scope global lo:1 valid_lft forever preferred_lft forever inet 192.168.0.200/32 brd 192.168.0.200 scope global lo:0 valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000 link/ether 00:0c:29:ab:50:14 brd ff:ff:ff:ff:ff:ff inet 192.168.0.4/24 brd 192.168.0.255 scope global ens33 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:feab:5014/64 scope link valid_lft forever preferred_lft forever

lvs-dr-йў„и®ҫи„ҡжң¬

и„ҡжң¬еҶ…е®№еҗҢwebжңҚеҠЎAзӣёеҗҢпјҢжӢ·иҙқиҝҮеҺ»еҚіеҸҜ

vip200-setrs.sh vip201-setrs.sh

е®ўжҲ·з«ҜжөӢиҜ•

ipй…ҚзҪ®

[root@localhost ~]# ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000 link/ether 00:0c:29:d0:37:77 brd ff:ff:ff:ff:ff:ff inet 192.168.0.14/24 brd 192.168.0.255 scope global ens33 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:fed0:3777/64 scope link valid_lft forever preferred_lft forever

curlжөӢиҜ•

[root@localhost ~]# for i in {1..10};do curl http://192.168.0.200;done

backend server1

backend server1

backend server2

backend server1

backend server1

backend server2

backend server1

backend server1

backend server2

backend server1

[root@localhost ~]# for i in {1..10};do curl http://192.168.0.201;done

backend server1

backend server2

backend server2

backend server1

backend server2

backend server2

backend server1

backend server2

backend server2

backend server1еӣӣгҖҒеҒҘеә·зҠ¶жҖҒжҹҘзңӢд»ҘеҸҠж•…йҡңжҺ’жҹҘеҸӮиҖғж–№ејҸ

ж–№ејҸ1пјҡжҹҘзңӢkeepalivedзҡ„еҲҮжҚўиҝҮзЁӢ

systemctl status keepalived

ж–№ејҸ2пјҡmailе‘Ҫд»ӨжҹҘзңӢйӮ®д»¶

ж–№ејҸ3пјҡжҹҘзңӢwebжңҚеҠЎеҷЁж—Ҙеҝ—

tail /var/log/httpd/access_log

tail /var/log/httpd/error_log

дә”гҖҒжЁЎжӢҹж•…йҡң

1.жЁЎжӢҹи°ғеәҰеҷЁBж•…йҡң

и°ғеәҰеҷЁBдёҠж“ҚдҪң

еҒңжӯўkeepalivedжңҚеҠЎ

systemctl stop keepalived [root@node2 keepalived]# systemctl status keepalived #еҲҶжһҗд»ҘдёӢдҝЎжҒҜпјҢVIP2已移йҷӨ Jul 02 10:18:53 node2 systemd[1]: Stopping LVS and VRRP High Availability Monitor... Jul 02 10:18:53 node2 Keepalived_vrrp[50773]: VRRP_Instance(VI_2) sending 0 priority Jul 02 10:18:53 node2 Keepalived_vrrp[50773]: VRRP_Instance(VI_2) removing protocol VIPs. Jul 02 10:18:53 node2 systemd[1]: Stopped LVS and VRRP High Availability Monitor.

жҹҘзңӢip

[root@node2 keepalived]# ip a #VIP2移йҷӨ 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000 link/ether 00:0c:29:3f:e3:9e brd ff:ff:ff:ff:ff:ff inet 192.168.0.8/24 brd 192.168.0.255 scope global ens33 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:fe3f:e39e/64 scope link valid_lft forever preferred_lft forever

и°ғеәҰеҷЁAж“ҚдҪң

[root@node1 keepalived]# systemctl status keepalived #еҲҶжһҗд»ҘдёӢдҝЎжҒҜпјҢеҸҜзҹҘVIPжјӮ移еҲ°и°ғеәҰA в—Ҹ keepalived.service - LVS and VRRP High Availability Monitor Loaded: loaded (/usr/lib/systemd/system/keepalived.service; enabled; vendor preset: disabled) Active: active (running) since Sun 2017-07-02 10:07:36 CST; 17min ago Process: 20019 ExecStart=/usr/sbin/keepalived $KEEPALIVED_OPTIONS (code=exited, status=0/SUCCESS) Main PID: 20020 (keepalived) CGroup: /system.slice/keepalived.service в”ңв”Җ20020 /usr/sbin/keepalived -D в”ңв”Җ20021 /usr/sbin/keepalived -D в””в”Җ20022 /usr/sbin/keepalived -D Jul 02 10:07:37 node1 Keepalived_vrrp[20022]: Opening script file /etc/keepalived/notify1.sh Jul 02 10:07:37 node1 Keepalived_healthcheckers[20021]: Netlink reflector reports IP 192.168.0.200 added Jul 02 10:07:42 node1 Keepalived_vrrp[20022]: VRRP_Instance(VI_1) Sending gratuitous ARPs on ens33 for 192.168.0.200 Jul 02 10:18:54 node1 Keepalived_vrrp[20022]: VRRP_Instance(VI_2) Transition to MASTER STATE Jul 02 10:18:55 node1 Keepalived_vrrp[20022]: VRRP_Instance(VI_2) Entering MASTER STATE Jul 02 10:18:55 node1 Keepalived_vrrp[20022]: VRRP_Instance(VI_2) setting protocol VIPs. Jul 02 10:18:55 node1 Keepalived_vrrp[20022]: VRRP_Instance(VI_2) Sending gratuitous ARPs on ens33 for 192.168.0.201 Jul 02 10:18:55 node1 Keepalived_vrrp[20022]: Opening script file /etc/keepalived/notify2.sh Jul 02 10:18:55 node1 Keepalived_healthcheckers[20021]: Netlink reflector reports IP 192.168.0.201 added Jul 02 10:19:00 node1 Keepalived_vrrp[20022]: VRRP_Instance(VI_2) Sending gratuitous ARPs on ens33 for 192.168.0.201

жҹҘзңӢйӮ®д»¶

[root@node1 keepalived]# mail #node1жҲҗдёәVIP192.168.0.201зҡ„дё»иҠӮзӮ№ Heirloom Mail version 12.5 7/5/10. Type ? for help. "/var/spool/mail/root": 1 message > 1 root Sun Jul 2 10:18 19/702 "node1 to be master:192.168.0.201 floating" & 1 Message 1: From root@node1.localdomain Sun Jul 2 10:18:55 2017 Return-Path: <root@node1.localdomain> X-Original-To: root@localhost Delivered-To: root@localhost.localdomain Date: Sun, 02 Jul 2017 10:18:55 +0800 To: root@localhost.localdomain Subject: node1 to be master:192.168.0.201 floating User-Agent: Heirloom mailx 12.5 7/5/10 Content-Type: text/plain; charset=us-ascii From: root@node1.localdomain (root) Status: RO 2017-07-02 10:18:55:vrrp2 transition,node1 changed to be master

2.жЁЎжӢҹwebжңҚеҠЎеҷЁAж•…йҡң(RS1)

webAдёҠж“ҚдҪң

[root@localhost ~]# systemctl stop httpd

и°ғеәҰеҷЁAдёҠж“ҚдҪң

жҹҘзңӢйӮ®д»¶

[root@node1 keepalived]# mail #еҲҶжһҗд»ҘдёӢдҝЎжҒҜпјҢеҸҜзҹҘRS1е®•жңә Heirloom Mail version 12.5 7/5/10. Type ? for help. "/var/spool/mail/root": 4 messages 2 new 1 root Sun Jul 2 10:18 19/702 "node1 to be master:192.168.0.201 floating" 2 root Sun Jul 2 10:28 19/702 "node1 to be backup:192.168.0.201 floating" >N 3 keepalived@localhost Sun Jul 2 10:28 17/642 "[node1] Realserver [192.168.0.3]:80 - DOWN" N 4 keepalived@localhost Sun Jul 2 10:28 17/642 "[node1] Realserver [192.168.0.3]:80 - DOWN"

е®ўжҲ·з«ҜиҜ·жұӮжҹҘзңӢ

[root@localhost ~]# curl http://192.168.0.200 #еҸӘиғҪи®ҝй—®еҲ°RS2 backend server2

и°ғеәҰеҷЁBдёҠж“ҚдҪң

[root@node2 keepalived]# mail #еҲҶжһҗд»ҘдёӢдҝЎжҒҜпјҢеҸҜзҹҘRS1е®•жңә Heirloom Mail version 12.5 7/5/10. Type ? for help. "/var/spool/mail/root": 4 messages 2 new 1 root Sun Jul 2 10:28 19/702 "node2 to be backup:192.168.0.200 floating" 2 root Sun Jul 2 10:28 19/702 "node2 to be master:192.168.0.201 floating" >N 3 keepalived@localhost Sun Jul 2 10:28 17/642 "[node2] Realserver [192.168.0.3]:80 - DOWN" N 4 keepalived@localhost Sun Jul 2 10:28 17/642 "[node2] Realserver [192.168.0.3]:80 - DOWN"

3.жЁЎжӢҹwebжңҚеҠЎеҸҢжңәж•…йҡң

RS1е’ҢRS2еҒңжӯўwebжңҚеҠЎ

и°ғеәҰеҷЁAдёҠж“ҚдҪң

жҹҘзңӢйӮ®д»¶ #еҲҶжһҗд»ҘдёӢдҝЎжҒҜпјҢеҸҜзҹҘеҸҢжңәе®•жңә

[root@node1 keepalived]# mail Heirloom Mail version 12.5 7/5/10. Type ? for help. "/var/spool/mail/root": 6 messages 2 new 1 root Sun Jul 2 10:18 19/702 "node1 to be master:192.168.0.201 floating" 2 root Sun Jul 2 10:28 19/702 "node1 to be backup:192.168.0.201 floating" 3 keepalived@localhost Sun Jul 2 10:28 18/653 "[node1] Realserver [192.168.0.3]:80 - DOWN" 4 keepalived@localhost Sun Jul 2 10:28 18/653 "[node1] Realserver [192.168.0.3]:80 - DOWN" >N 5 keepalived@localhost Sun Jul 2 10:36 17/642 "[node1] Realserver [192.168.0.4]:80 - DOWN" N 6 keepalived@localhost Sun Jul 2 10:36 17/642 "[node1] Realserver [192.168.0.4]:80 - DOWN"

жҹҘзңӢkeepalivedзҠ¶жҖҒ

[root@node1 keepalived]# systemctl status keepalived #еҲҶжһҗд»ҘдёӢдҝЎжҒҜпјҢеҸҢжңәе®•жңәпјҢеҗҜеҠЁsorryжңҚеҠЎеҷЁ в—Ҹ keepalived.service - LVS and VRRP High Availability Monitor Loaded: loaded (/usr/lib/systemd/system/keepalived.service; enabled; vendor preset: disabled) Active: active (running) since Sun 2017-07-02 10:07:36 CST; 30min ago Process: 20019 ExecStart=/usr/sbin/keepalived $KEEPALIVED_OPTIONS (code=exited, status=0/SUCCESS) Main PID: 20020 (keepalived) CGroup: /system.slice/keepalived.service в”ңв”Җ20020 /usr/sbin/keepalived -D в”ңв”Җ20021 /usr/sbin/keepalived -D в””в”Җ20022 /usr/sbin/keepalived -D Jul 02 10:36:31 node1 Keepalived_healthcheckers[20021]: Removing alive servers from the pool for VS [192.168.0.200]:80 Jul 02 10:36:31 node1 Keepalived_healthcheckers[20021]: Remote SMTP server [127.0.0.1]:25 connected. Jul 02 10:36:31 node1 Keepalived_healthcheckers[20021]: SMTP alert successfully sent. Jul 02 10:36:32 node1 Keepalived_healthcheckers[20021]: Error connecting server [192.168.0.4]:80. Jul 02 10:36:32 node1 Keepalived_healthcheckers[20021]: Removing service [192.168.0.4]:80 from VS [192.168.0.201]:80 Jul 02 10:36:32 node1 Keepalived_healthcheckers[20021]: Lost quorum 1-0=1 > 0 for VS [192.168.0.201]:80 Jul 02 10:36:32 node1 Keepalived_healthcheckers[20021]: Adding sorry server [127.0.0.1]:80 to VS [192.168.0.201]:80 Jul 02 10:36:32 node1 Keepalived_healthcheckers[20021]: Removing alive servers from the pool for VS [192.168.0.201]:80 Jul 02 10:36:32 node1 Keepalived_healthcheckers[20021]: Remote SMTP server [127.0.0.1]:25 connected. Jul 02 10:36:32 node1 Keepalived_healthcheckers[20021]: SMTP alert successfully sent.

е®ўжҲ·з«ҜиҜ·жұӮ

[root@localhost ~]# curl http://192.168.0.201 #иҜ·жұӮиҮіsorryжңҚеҠЎеҷЁзҡ„webйЎөйқў sorry server [root@localhost ~]# curl http://192.168.0.200 sorry server

зңӢдәҶд»ҘдёҠе…ідәҺе®һзҺ°keepalivedеҸҢдё»жЁЎеһӢlvsй«ҳеҸҜз”ЁйӣҶзҫӨзҡ„е®һйӘҢжҖ»з»“пјҢеҰӮжһңеӨ§е®¶иҝҳжңүд»Җд№Ҳең°ж–№йңҖиҰҒдәҶи§Јзҡ„еҸҜд»ҘеңЁдәҝйҖҹдә‘иЎҢдёҡиө„и®ҜйҮҢжҹҘжүҫиҮӘе·ұж„ҹе…ҙи¶Јзҡ„жҲ–иҖ…жүҫжҲ‘们зҡ„дё“дёҡжҠҖжңҜе·ҘзЁӢеёҲи§Јзӯ”зҡ„пјҢдәҝйҖҹдә‘жҠҖжңҜе·ҘзЁӢеёҲеңЁиЎҢдёҡеҶ…жӢҘжңүеҚҒеҮ е№ҙзҡ„з»ҸйӘҢдәҶгҖӮ

е…ҚиҙЈеЈ°жҳҺпјҡжң¬з«ҷеҸ‘еёғзҡ„еҶ…е®№пјҲеӣҫзүҮгҖҒи§Ҷйў‘е’Ңж–Үеӯ—пјүд»ҘеҺҹеҲӣгҖҒиҪ¬иҪҪе’ҢеҲҶдә«дёәдё»пјҢж–Үз« и§ӮзӮ№дёҚд»ЈиЎЁжң¬зҪ‘з«ҷз«ӢеңәпјҢеҰӮжһңж¶үеҸҠдҫөжқғиҜ·иҒ”зі»з«ҷй•ҝйӮ®з®ұпјҡis@yisu.comиҝӣиЎҢдёҫжҠҘпјҢ并жҸҗдҫӣзӣёе…іиҜҒжҚ®пјҢдёҖз»ҸжҹҘе®һпјҢе°Ҷз«ӢеҲ»еҲ йҷӨж¶үе«ҢдҫөжқғеҶ…е®№гҖӮ

жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ