您好,登录后才能下订单哦!

这篇文章主要讲解了Linux实现文件内容去重及求交并差集的方法,内容清晰明了,对此有兴趣的小伙伴可以学习一下,相信大家阅读完之后会有帮助。

一、数据去重

日常工作中,使用Hive或者Impala查询导出来可能会存在数据重复的现象,但又不想重新执行一遍查询(查询时间稍长,导出文件内容多),因此想到了使用Linux命令将文件的内容重复数据进行去除。

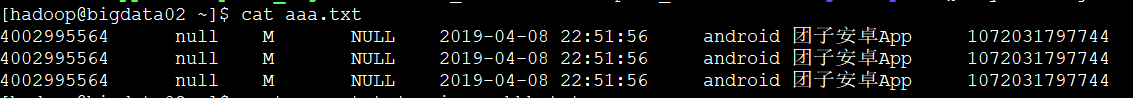

案例如下:

可以看到aaa.txx有3条重复数据

想去掉多余的数据,只保留一条

sort aaa.txt | uniq > bbb.txt

将aaa.txt文件中重复数据去掉,输出到bbb.txt

可以看到bbb.txt文件中只保留了一条数据

二、数据交、并、差

1)、交集(相当于user_2019 inner join user_2020 on user_2019.user_no=user_2020.user_no)

sort user_2019.txt user_2020.txt | uniq -d

2)、并集(相当于 user_2019.user_no union user_2020.user_no)

sort user_2019.txt user_2020.txt | uniq

3)、差集

user_2019.txt-user_2020.txt

sort user_2019.txt user_2020.txt user_2020.txt | uniq -u

user_2020.txt - user_2019.txt:

sort user_2020.txt user_2019.txt user_2019.txt | uniq -u

看完上述内容,是不是对Linux实现文件内容去重及求交并差集的方法有进一步的了解,如果还想学习更多内容,欢迎关注亿速云行业资讯频道。

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。