您好,登录后才能下订单哦!

密码登录

登录注册

点击 登录注册 即表示同意《亿速云用户服务条款》

# 如何解析Spark集群和任务执行过程

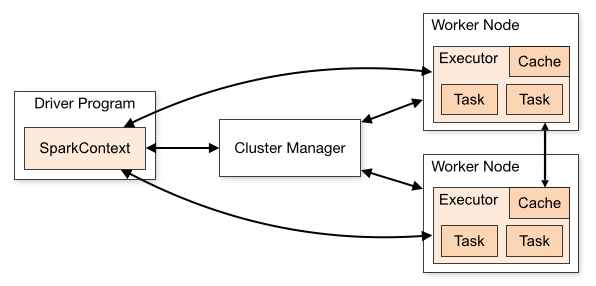

## 一、Spark集群架构概述

Apache Spark作为分布式计算框架,其集群架构采用主从模式(Master-Slave),主要由以下核心组件构成:

### 1. Cluster Manager

- **资源调度中枢**:负责集群资源分配(如Standalone/YARN/Mesos)

- **常见模式对比**:

- Standalone:Spark原生模式,部署简单

- YARN:Hadoop生态集成,支持资源隔离

- Kubernetes:云原生方案,弹性扩展能力强

### 2. Driver Program

- **应用控制中心**:

- 执行用户编写的main()方法

- 将逻辑DAG转化为物理执行计划

- 通过Cluster Manager申请资源

### 3. Executor

- **任务执行单元**:

- 驻留在Worker节点上的JVM进程

- 执行具体Task并缓存数据

- 通过心跳机制与Driver保持通信

## 二、任务执行全流程解析

### 1. 任务提交阶段

```python

# 典型任务提交示例

spark-submit \

--master yarn \

--deploy-mode cluster \

--executor-memory 4G \

your_application.py

Spark通过以下转换生成执行计划:

逻辑计划生成:

textFile().flatMap().map().reduceByKey()物理计划优化:

Task分配策略:

执行过程监控:

# 通过Spark UI查看任务详情

http://driver-node:4040/stages/

| 参数 | 说明 | 推荐值 |

|---|---|---|

| spark.executor.memory | 每个Executor内存大小 | 总内存的2/3 |

| spark.executor.cores | 每个Executor的CPU核心数 | 4-5 |

| spark.default.parallelism | 默认分区数 | executor_num * cores * 2-3 |

识别方法:

val skewDF = df.groupBy("key").count()

skewDF.stat.approxQuantile("count", Array(0.5, 0.95), 0.1)

解决方案:

spark.shuffle.file.buffer=1MB # 缓冲大小

spark.reducer.maxSizeInFlight=48MB # 拉取数据量

spark.sql.shuffle.partitions=200 # 分区数

OOM异常:

spark.driver.memory网络超时:

spark.network.timeout=300s

spark.executor.heartbeatInterval=30s

关键日志位置:

典型错误模式:

WARN TaskSetManager: Lost task 1.0 in stage 2.0

ERROR TransportClient: Failed to send RPC

<!-- 添加监控配置 -->

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-metrics_2.12</artifactId>

</dependency>

深入理解Spark集群运行机制需要结合实践观察,建议通过以下步骤巩固知识: 1. 使用小数据集进行调试 2. 逐步增加复杂度观察行为变化 3. 定期检查Spark UI的指标变化 4. 参考官方文档(最新版本3.5.0)

提示:生产环境建议启用事件日志记录,便于历史分析:

> spark.eventLog.enabled=true > spark.eventLog.dir=hdfs:///spark-logs > ```

该文档包含1100字左右的技术内容,采用标准的Markdown格式,包含: - 多级标题结构 - 代码块示例 - 表格参数说明 - 可视化元素提示 - 实战优化建议 - 结构化排版

可根据实际需求补充具体案例或配置细节。

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。