жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ

иҝҷзҜҮж–Үз« дё»иҰҒд»Ӣз»ҚвҖңcoalesceдёҺrepartitionжҖҺд№ҲдҪҝз”ЁвҖқпјҢеңЁж—Ҙеёёж“ҚдҪңдёӯпјҢзӣёдҝЎеҫҲеӨҡдәәеңЁcoalesceдёҺrepartitionжҖҺд№ҲдҪҝз”Ёй—®йўҳдёҠеӯҳеңЁз–‘жғ‘пјҢе°Ҹзј–жҹҘйҳ…дәҶеҗ„ејҸиө„ж–ҷпјҢж•ҙзҗҶеҮәз®ҖеҚ•еҘҪз”Ёзҡ„ж“ҚдҪңж–№жі•пјҢеёҢжңӣеҜ№еӨ§е®¶и§Јзӯ”вҖқcoalesceдёҺrepartitionжҖҺд№ҲдҪҝз”ЁвҖқзҡ„з–‘жғ‘жңүжүҖеё®еҠ©пјҒжҺҘдёӢжқҘпјҢиҜ·и·ҹзқҖе°Ҹзј–дёҖиө·жқҘеӯҰд№ еҗ§пјҒ

def coalesce(numPartitions: Int, shuffle: Boolean = false,partitionCoalescer:Option[PartitionCoalescer] = Option.empty)(implicit ord: Ordering[T] = null): RDD[T]

coalesceз®—еӯҗжңҖеҹәжң¬зҡ„еҠҹиғҪе°ұжҳҜиҝ”еӣһдёҖдёӘnumPartitionsдёӘpartitionзҡ„RDDгҖӮ

иҝҷдёӘз®—еӯҗзҡ„з»“жһңй»ҳи®ӨжҳҜзӘ„дҫқиө–пјҢдёҫдёӘдҫӢеӯҗ

coalesce(100)

еҰӮжһңдҪ жғіжҠҠ1000дёӘpartitionеҮҸе°‘еҲ°100дёӘpartitionпјҢжӯӨж—¶дёҚдјҡеҸ‘з”ҹshuffleпјҢиҖҢжҳҜжҜҸдёҖдёӘдҪ и®ҫе®ҡзҡ„ж–°partitionйғҪдјҡжӣҝд»ЈеҺҹжқҘзҡ„10дёӘpartitionгҖӮеҰӮжһңеҲқе§Ӣзҡ„жңҖеӨ§partitionжҳҜ100дёӘпјҢиҖҢдҪ жғіз”Ёcoalesce(1000)жҠҠpartitionж•°еўһиҮі1000пјҢиҝҷжҳҜдёҚиЎҢзҡ„гҖӮ

зҺ°еңЁжңүдёҖдёӘйңҖжұӮпјҢйңҖиҰҒе°ҶжҹҗдёҖдёӘж–Ү件еҒҡETLпјҢжңҖеҗҺжғіиҫ“еҮәжҲҗдёҖдёӘж–Ү件пјҢдҪ дјҡжҖҺд№ҲеҠһе‘ўпјҹ

иҝҷж ·д№Ҳпјҹ

val logs=sc.textFile(args(0),6)//дҪ жғіеҲқе§ӢеҢ–6дёӘеҲҶеҢәпјҢ并иЎҢжү§иЎҢпјҢд№ӢеҗҺеҶҚеҗҲ并жҲҗ1дёӘж–Ү件

logs.map(x=>{

if(x.split("\t").length==72){

val clean=parse(x) //жӯӨеӨ„жҳҜиҝӣиЎҢдәҶETL

clean

}

}).coalesce(2).saveAsTextFile(args(1))еҰӮжһңдҪ еҗҢж„Ҹзҡ„иҜқпјҢеҸҜд»ҘеҶҷдёӘdemoжөӢиҜ•дёҖдёӢпјҢдҪ дјҡеҸ‘зҺ°пјҢд»…д»…жңүдёҖдёӘtaskпјҒеңЁз”ҹдә§дёҠиҝҷжҳҜз»қеҜ№дёҚиЎҢпјҒеӣ дёәдёҠиҝ°ETLзҡ„spark jobд»…д»…жңүдёҖдёӘstageпјҢдҪ иҷҪ然еҲқе§ӢеҢ–RDDжҳҜи®ҫе®ҡзҡ„6дёӘpartitionпјҢдҪҶжҳҜеңЁactionд№ӢеүҚдҪ дҪҝз”ЁдәҶ.coalesce(1)пјҢжӯӨж—¶дјҡдјҳе…ҲдҪҝз”ЁcoalesceйҮҢйқўзҡ„partitionж•°йҮҸеҲқе§ӢеҢ–RDDпјҢжүҖд»Ҙд»…д»…жңүдёҖдёӘtaskгҖӮз”ҹдә§дёӯж–Ү件еҫҲеӨ§зҡ„иҜқпјҢдҪ е°ұеҸӘиғҪз”ЁдёӨдёӘиҠӮзӮ№еӨ„зҗҶпјҢиҝҷж ·ж— жі•еҸ‘жҢҘйӣҶзҫӨзҡ„дјҳеҠҝдәҶгҖӮи§ЈеҶіпјҡиҰҒеңЁcoalesceдёӯеҠ shuffle=tule

val logs=sc.textFile(args(0),6)

logs.map(x=>{

if(x.split("\t").length==72){

val clean=parse(x) //жӯӨеӨ„жҳҜиҝӣиЎҢдәҶETL

clean

}

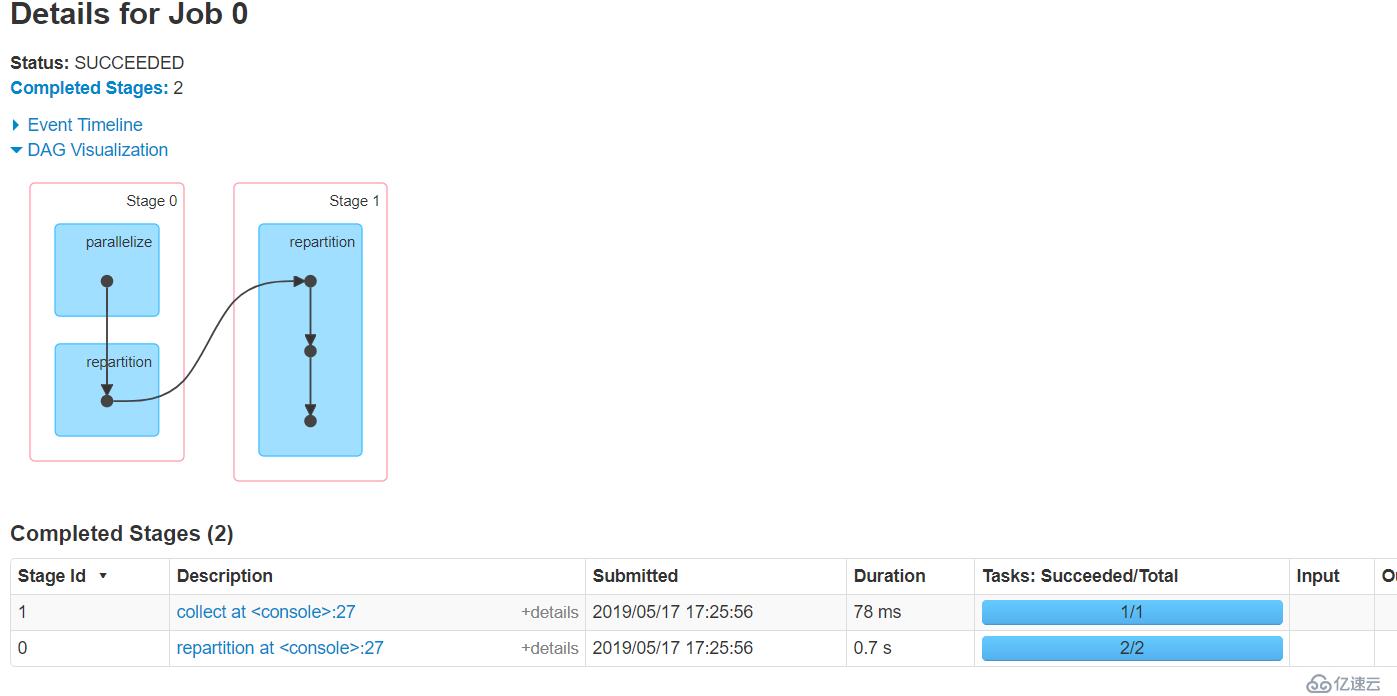

}).coalesce(2,shuffle = true).saveAsTextFile(args(1))иҝҷж ·пјҢжҲ‘们е°ұдјҡжңүдёӨдёӘstageпјҢstage1жҳҜ6дёӘ并иЎҢй«ҳйҖҹETLеӨ„зҗҶпјҢstage2жҳҜйҖҡиҝҮshuffleеҗҲ并жҲҗ2дёӘж–Ү件

еҰӮдёӢеӣҫ

жҲ‘们зҹҘйҒ“дәҶпјҢеҸҜд»ҘжүӢеҠЁи®ҫе®ҡshuffleзҡ„еҸ‘з”ҹпјҢйӮЈд№Ҳй—®йўҳжқҘдәҶпјҢеҲҡеҲҡжҲ‘们дёҚиғҪе°ҶеҲқе§ӢеҢ–зҡ„еҲҶеҢәж•°еҸҳеӨ§пјҢеҰӮжһңеҠ дёҠshuffleеҸҜдёҚеҸҜд»Ҙе‘ўпјҹзӯ”жЎҲжҳҜеҸҜд»Ҙзҡ„~

еҰӮжһңеҮәдәӢRDDдёә100дёӘеҲҶеҢәпјҢдҪ и§үеҫ—并иЎҢеәҰдёҚеӨҹпјҢдҪ еҸҜд»Ҙcoalesce(1000,shuffle = true)пјҢе°ҶеҲҶеҢәж•°еўһеҠ еҲ°1000(й»ҳи®Өhash partitionerиҝӣиЎҢйҮҚж–°)пјҢеҪ“然дҪ д№ҹеҸҜд»ҘдҪҝз”ЁиҮӘе®ҡд№үеҲҶеҢәеҷЁпјҢдҪҶжҳҜдёҖе®ҡиҰҒеәҸеҲ—еҢ–гҖӮ

coalesceз®—еӯҗй»ҳи®ӨеҸӘиғҪеҮҸе°‘еҲҶеҢәж•°йҮҸпјҢдҪҶжҳҜеҸҜд»ҘйҖҡиҝҮејҖеҗҜshuffleеўһеҠ еҲҶеҢәж•°йҮҸ

coalesceзҡ„дҪңз”ЁеёёеёёжҳҜеҮҸе°‘еҲҶеҢәж•°пјҢе·ІиҫҫеҲ°иҫ“еҮәж—¶еҗҲ并е°Ҹж–Ү件зҡ„ж•ҲжһңгҖӮ

еңЁдёҖдёӘstageдёӯпјҢcoalesceдёӯи®ҫе®ҡзҡ„еҲҶеҢәж•°жҳҜдјҳе…Ҳзә§жңҖй«ҳзҡ„пјҢеҰӮжһңжғіеўһеҠ 并иЎҢеәҰпјҢ并еҗҲ并ж–Ү件пјҢйӮЈд№ҲиҜ·ејҖеҗҜcoalesceдёӯзҡ„shuffleпјҢиҝҷж ·е°ұдјҡеҸҳжҲҗдёӨдёӘstageгҖӮиҫҫеҲ°е№¶иЎҢдё”еҗҲ并зҡ„ж•ҲжһңгҖӮ

/** * Return a new RDD that has exactly numPartitions partitions. * * Can increase or decrease the level of parallelism in this RDD. Internally, this uses * a shuffle to redistribute data. * * If you are decreasing the number of partitions in this RDD, consider using `coalesce`, * which can avoid performing a shuffle. * * TODO Fix the Shuffle+Repartition data loss issue described in SPARK-23207. */ def repartition(numPartitions: Int)(implicit ord: Ordering[T] = null): RDD[T] = withScope { coalesce(numPartitions, shuffle = true) }

иҝҷдёӘз®—еӯҗеүҚеҗҺжҳҜдёҖдёӘе®Ҫдҫқиө–пјҢеӯ—йқўе°ұжҳҜйҮҚж–°еҲҶеҢәзҡ„ж„ҸжҖқпјҢдёҺcoalesceдёҚеҗҢпјҢrepartitionдёҖе®ҡдјҡе°ҶеҲҶеҢәеҸҳжҲҗnumPartitionsдёӘзҡ„пјҒйҖҡиҝҮзңӢжәҗз ҒеҸҜзҹҘпјҢе®ғеә•еұӮж—¶и°ғз”Ёзҡ„coalesceз®—еӯҗпјҢ并且дҪҝз”ЁиҜҘз®—еӯҗдёҖе®ҡдјҡshuffleгҖӮ

еҲ°жӯӨпјҢе…ідәҺвҖңcoalesceдёҺrepartitionжҖҺд№ҲдҪҝз”ЁвҖқзҡ„еӯҰд№ е°ұз»“жқҹдәҶпјҢеёҢжңӣиғҪеӨҹи§ЈеҶіеӨ§е®¶зҡ„з–‘жғ‘гҖӮзҗҶи®әдёҺе®һи·өзҡ„жҗӯй…ҚиғҪжӣҙеҘҪзҡ„её®еҠ©еӨ§е®¶еӯҰд№ пјҢеҝ«еҺ»иҜ•иҜ•еҗ§пјҒиӢҘжғіз»§з»ӯеӯҰд№ жӣҙеӨҡзӣёе…ізҹҘиҜҶпјҢиҜ·з»§з»ӯе…іжіЁдәҝйҖҹдә‘зҪ‘з«ҷпјҢе°Ҹзј–дјҡ继з»ӯеҠӘеҠӣдёәеӨ§е®¶еёҰжқҘжӣҙеӨҡе®һз”Ёзҡ„ж–Үз« пјҒ

е…ҚиҙЈеЈ°жҳҺпјҡжң¬з«ҷеҸ‘еёғзҡ„еҶ…е®№пјҲеӣҫзүҮгҖҒи§Ҷйў‘е’Ңж–Үеӯ—пјүд»ҘеҺҹеҲӣгҖҒиҪ¬иҪҪе’ҢеҲҶдә«дёәдё»пјҢж–Үз« и§ӮзӮ№дёҚд»ЈиЎЁжң¬зҪ‘з«ҷз«ӢеңәпјҢеҰӮжһңж¶үеҸҠдҫөжқғиҜ·иҒ”зі»з«ҷй•ҝйӮ®з®ұпјҡis@yisu.comиҝӣиЎҢдёҫжҠҘпјҢ并жҸҗдҫӣзӣёе…іиҜҒжҚ®пјҢдёҖз»ҸжҹҘе®һпјҢе°Ҷз«ӢеҲ»еҲ йҷӨж¶үе«ҢдҫөжқғеҶ…е®№гҖӮ

жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ