жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ

йӣҶзҫӨиҠӮзӮ№жңҚеҠЎеҗҜеҒң

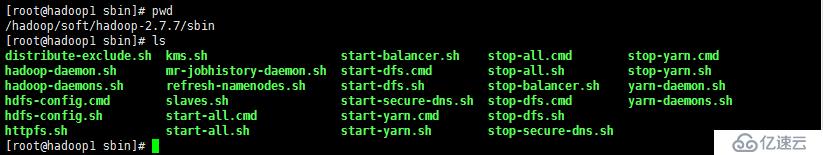

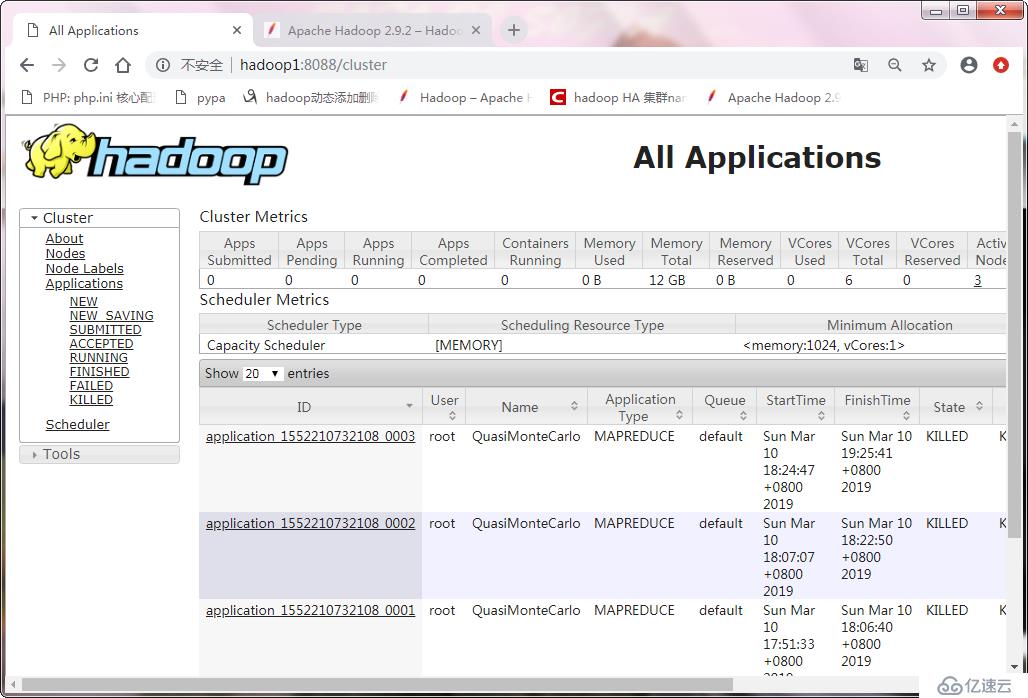

еҰӮеӣҫжүҖзӨәи„ҡжң¬жүҖеңЁи·Ҝеҫ„пјҡдё»иҰҒеҲҶзұ»зұ»е‘Ҫд»Өпјҡз®ЎзҗҶhdfsе’Ңз®ЎзҗҶyarnиө„жәҗ

жңҚеҠЎеҗҜеҠЁж–№ејҸпјҡеҲҶеҲ«еҗҜеҠЁеҗ„иҠӮзӮ№жңҚеҠЎгҖҒйӣҶзҫӨи„ҡжң¬еҗҜеҠЁж•ҙдёӘжңҚеҠЎгҖӮ

hadoop-daemon.sh <start | stop> namenode | datanode | journalnode |zkfc

hadoop-daemons.sh <start | stop> namenode | datanode |z kfc#иЎЁзӨәеҗҜеҠЁйӣҶзҫӨеҶ…жүҖжңүdn/nnжңҚеҠЎ

yarn-daemon.sh start |stop resourcemanager | nodemanager | proxyserver

yarn-daemons.sh start |stop resourcemanager | nodemanager | proxyserver #иЎЁзӨәеҗҜеҠЁyarnйӣҶзҫӨеҶ…жүҖжңүrm/nmзӯүжңҚеҠЎ

mr-jobhistory-daemon.sh start | stop historyserver

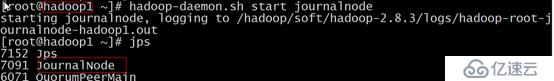

[root@hadoop1 ~]# hadoop-daemons.sh start journalnode

hadoop1: starting journalnode, logging to /hadoop/soft/hadoop-2.7.7/logs/hadoop-root-journalnode-hadoop1.out

hadoop2: starting journalnode, logging to /hadoop/soft/hadoop-2.7.7/logs/hadoop-root-journalnode-hadoop2.out

hadoop3: starting journalnode, logging to /hadoop/soft/hadoop-2.7.7/logs/hadoop-root-journalnode-hadoop3.out

[root@hadoop1 ~]# jps

1628 JournalNode

1663 Jps

[root@hadoop1 ~]# ssh hadoop2 jps

1513 Jps

1452 JournalNode

[root@hadoop1 ~]# ssh hadoop3 jps

1473 Jps

1412 JournalNodestart-dfs.sh | stop-dfs.sh #еҗҜеҒңжүҖжңүhdfsжңҚеҠЎ

start-yarn.sh | stop-yarn.sh #еҗҜеҒңжүҖжңүyarnжңҚеҠЎ

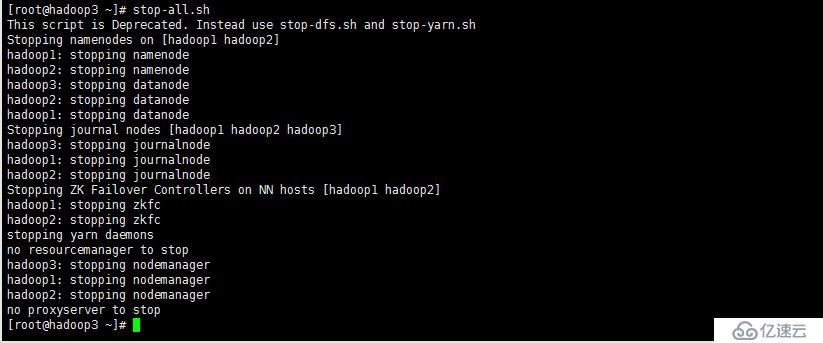

start-all.sh | stop-all.sh #еҸҜд»ҘеҗҜеҒңжүҖжңүhdfsгҖҒyarnжңҚеҠЎпјҢиҝҷдёӨдёӘи„ҡжң¬еҚіе°ҶеәҹејғпјҢе»әи®®дҪҝз”ЁдёҠйқўдёӨдёӘи„ҡжң¬з®ЎзҗҶжңҚеҠЎгҖӮ

Usage: hadoop [--config confdir] [COMMAND | CLASSNAME]

fs run a generic filesystem user client#иҝҗиЎҢдёҖдёӘж–Ү件系з»ҹе®ўжҲ·з«Ҝ

version print the version #жҹҘзңӢзүҲжң¬дҝЎжҒҜ

jar <jar> run a jar file #иҝҗиЎҢjarж–Ү件пјҢжіЁдҪҝз”Ё**yarn jar**иҝҗиЎҢyarnеә”з”Ё

distcp <srcurl> <desturl> #йҖ’еҪ’еӨҚеҲ¶ж–Ү件жҲ–зӣ®еҪ•пјӣDistCpпјҲеҲҶеёғејҸжӢ·иҙқпјүжҳҜз”ЁдәҺеӨ§и§„жЁЎйӣҶзҫӨеҶ…йғЁе’ҢйӣҶзҫӨд№Ӣй—ҙжӢ·иҙқзҡ„е·Ҙе…·гҖӮ е®ғдҪҝз”ЁMap/Reduceе®һзҺ°ж–Ү件еҲҶеҸ‘пјҢй”ҷиҜҜеӨ„зҗҶе’ҢжҒўеӨҚпјҢд»ҘеҸҠжҠҘе‘Ҡз”ҹжҲҗ

archive -archiveName NAME -p <parent path> <src>* <dest> #еҲӣе»әhadoopеҪ’жЎЈж–Ү件

classpath #еҲ—еҮәжүҖйңҖиҰҒзҡ„зұ»еә“ bash$ hadoop distcp hdfs://nn1:8020/foo/bar hdfs://nn2:8020/bar/foo

[root@hadoop2 ~]# hadoop/hdfs fs

Usage: hadoop fs [generic options]

[-cat [-ignoreCrc] <src> ...] #жҹҘзңӢж–Ү件еҶ…е®№

[-checksum <src> ...] #жҹҘзңӢж–Үд»¶ж ЎйӘҢз Ғ

[-chgrp [-R] GROUP PATH...] #дҝ®ж”№ж–Ү件еұһз»„

[-chmod [-R] <MODE[,MODE]... | OCTALMODE> PATH...] #дҝ®ж”№ж–Ү件жқғйҷҗ

[-chown [-R] [OWNER][:[GROUP]] PATH...] #дҝ®ж”№ж–Ү件еұһдё»жҲ–еұһз»„

[-copyFromLocal [-f] [-p] [-l] <localsrc> ... <dst>] #еӨҚеҲ¶жң¬ең°ж–Ү件еҲ°hdfsж–Ү件系з»ҹпјҢзұ»дјјputе‘Ҫд»Ө

[-copyToLocal [-p] [-ignoreCrc] [-crc] <src> ... <localdst>] #еӨҚеҲ¶hdfsж–Ү件еҲ°жң¬ең°пјҢзұ»дјјgetе‘Ҫд»Ө

[-cp [-f] [-p | -p[topax]] <src> ... <dst>] #е…Ғи®ёеӨҡжәҗеӨҚеҲ¶ж“ҚдҪң пјҢзӣ®ж Үи·Ҝеҫ„еҝ…йЎ»жҳҜзӣ®еҪ•

[-createSnapshot <snapshotDir> [<snapshotName>]] #еҲӣе»әеҝ«з…§

[-deleteSnapshot <snapshotDir> <snapshotName>] #еҲ йҷӨеҝ«з…§

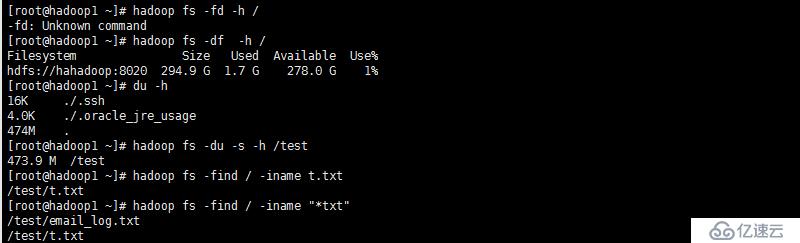

[-df [-h] [<path> ...]] #жҳҫзӨәж–Ү件系з»ҹдҪҝз”Ёз©әй—ҙ

[-du [-s] [-h] <path> ...] #жҳҫзӨәжҹҗдёӘзӣ®еҪ•еҶ…еҢ…еҗ«зҡ„ж–Ү件зҡ„еӨ§е°ҸпјҢзӣ®еҪ•еҚ з”Ёз©әй—ҙеӨ§е°ҸпјҢдёҺLinuxе‘Ҫд»ӨдёҖж ·

[-find <path> ... <expression> ...] #жҹҘжүҫж–Ү件

[-get [-p] [-ignoreCrc] [-crc] <src> ... <localdst>]

[-getfacl [-R] <path>]

[-getfattr [-R] {-n name | -d} [-e en] <path>]

[-help [cmd ...]] #жҹҘзңӢеё®еҠ©

[-ls [-d] [-h] [-R] [<path> ...]] #жӣҝд»ЈвҖңhadoop fs -ls -RвҖқ

[-mkdir [-p] <path> ...] #еҲӣе»әзӣ®еҪ•

[-moveFromLocal <localsrc> ... <dst>]

[-moveToLocal <src> <localdst>]

[-mv <src> ... <dst>]

[-put [-f] [-p] [-l] <localsrc> ... <dst>]

[-renameSnapshot <snapshotDir> <oldName> <newName>]

[-rm [-f] [-r|-R] [-skipTrash] <src> ...]

[-rmdir [--ignore-fail-on-non-empty] <dir> ...]

[-setfacl [-R] [{-b|-k} {-m|-x <acl_spec>} <path>]|[--set <acl_spec> <path>]]

[-setfattr {-n name [-v value] | -x name} <path>]

[-stat [format] <path> ...]

[-tail [-f] <file>]

[-test -[defsz] <path>] #жөӢиҜ•е‘Ҫд»Ө пјҢ-dжҳҜеҗҰдёәзӣ®еҪ•пјҢ-eж–Ү件жҳҜеҗҰеӯҳеңЁпјҢ-zжҳҜеҗҰдёәз©әж–Ү件пјҢз”Ёжі•дёҖж ·

[-text [-ignoreCrc] <src> ...]

[-touchz <path> ...] #еҲӣе»ә 0еӯ—иҠӮз©әж–Ү件

[-truncate [-w] <length> <path> ...]

[-usage [cmd ...]] #жҹҘзңӢе‘Ҫд»Өзҡ„з”Ёжі•

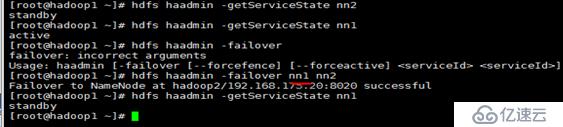

[root@hadoop2 ~]# hdfs haadmin # dfsз®ЎзҗҶе®ўжҲ·з«ҜпјҢжҹҘзңӢhdfsзҠ¶жҖҒйӣҶзҫӨ

Usage: haadmin

[-transitionToActive [--forceactive] <serviceId>]

[-transitionToStandby <serviceId>]

[-failover [--forcefence] [--forceactive] <serviceId> <serviceId>] #д»ҘдёҠ3жқЎе…ідәҺжүӢеҠЁж•…йҡңиҪ¬з§»е‘Ҫд»Ө

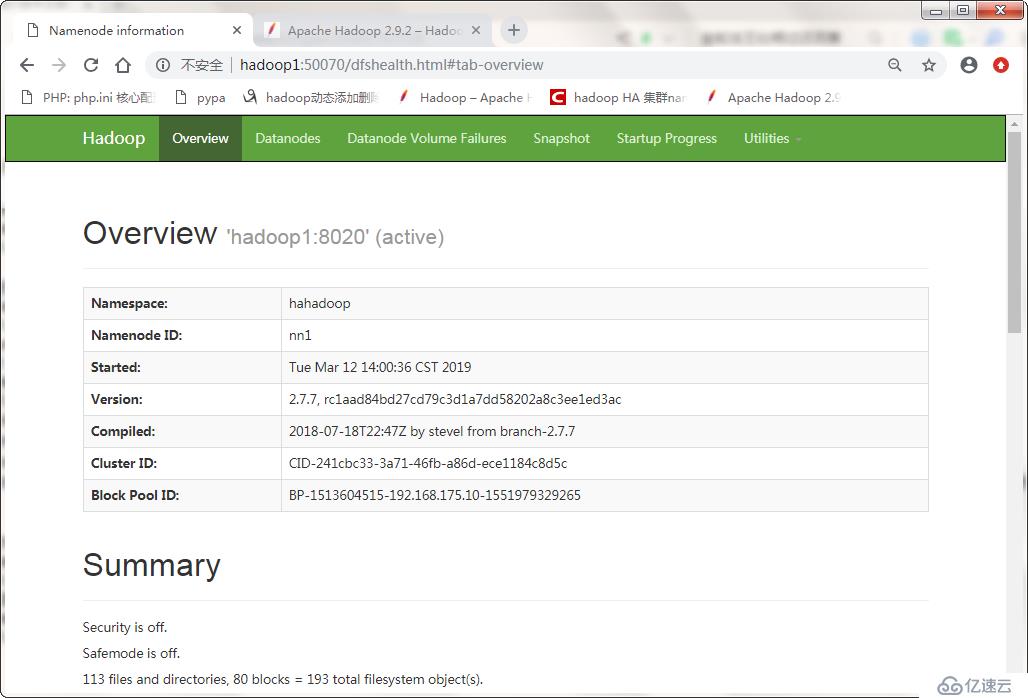

[-getServiceState <serviceId>] #жҹҘзңӢnnиҠӮзӮ№еӨ„activeиҝҳжҳҜstandbyзҠ¶жҖҒ

[-checkHealth <serviceId>] #жЈҖжҹҘnnиҠӮзӮ№жҳҜеҗҰеҒҘеә·

[-help <command>] #жҹҘзңӢе‘Ҫд»Өеё®еҠ©

Usage: hdfs dfsadmin пјҡNote: hdfsи¶…зә§з®ЎзҗҶе‘ҳжүҚиғҪеӨҹиҝҗиЎҢиҜҘе‘Ҫд»Ө

[-report [-live] [-dead] [-decommissioning]] #жҠҘе‘Ҡж–Ү件系з»ҹзҡ„еҹәжң¬дҝЎжҒҜе’Ңз»ҹи®ЎдҝЎжҒҜ

[-safemode <enter | leave | get | wait>] #е®үе…ЁжЁЎејҸз»ҙжҠӨе‘Ҫд»ӨгҖӮе®үе…ЁжЁЎејҸжҳҜNamenodeзҡ„дёҖдёӘзҠ¶жҖҒпјҢ дёҚжҺҘеҸ—еҜ№еҗҚеӯ—з©әй—ҙзҡ„жӣҙж”№(еҸӘиҜ»)гҖҒ дёҚеӨҚеҲ¶жҲ–еҲ йҷӨеқ—

[-saveNamespace] #дҝқеӯҳеҪ“еүҚеҗҚз§°з©әй—ҙеҲ°еӯҳеӮЁзӣ®еҪ•пјҢејҖе§Ӣж–°edit-logпјҢйңҖиҰҒе®үе…ЁжЁЎејҸ

[-rollEdits]

[-restoreFailedStorage true|false|check]

[-refreshNodes] #йҮҚж–°иҜ»еҸ–hostsе’Ңexcludeж–Ү件пјҢжӣҙж–°е…Ғи®ёиҝһеҲ°NNзҡ„йӮЈдәӣйңҖиҰҒйҖҖеҮәжҲ–ж–°еҠ е…Ҙзҡ„DatanodeгҖӮ

[-setQuota <quota> <dirname>...<dirname>] #йҷҗеҲ¶дёҖдёӘзӣ®еҪ•еҢ…еҗ«жңҖеӨҡеӯҗзӣ®еҪ•е’Ңж–Ү件

#hdfs dfsadmin -setQuota 1t /user/dirname

[-clrQuota <dirname>...<dirname>]

[-setSpaceQuota <quota> [-storageType <storagetype>] <dirname>...<dirname>] #и®ҫзҪ®дёҖдёӘзӣ®еҪ•жңҖеӨҡдҪҝз”Ёз©әй—ҙ

[-clrSpaceQuota [-storageType <storagetype>] <dirname>...<dirname>]

[-refreshServiceAcl]

[-refreshUserToGroupsMappings]

[-refreshSuperUserGroupsConfiguration]

[-refreshCallQueue] #еҲ·ж–°иҜ·жұӮйҳҹеҲ—

[-refresh <host:ipc_port> <key> [arg1..argn]

[-reconfig <datanode|...> <host:ipc_port> <start|status>] #е°ҶdatanodeиҠӮзӮ№йҮҚж–°еҠ е…ҘйӣҶзҫӨ

[-refreshNamenodes datanode_host:ipc_port]

[-deleteBlockPool datanode_host:ipc_port blockpoolId [force]]

[-setBalancerBandwidth <bandwidth in bytes per second>]

[-fetchImage <local directory>]

[-allowSnapshot <snapshotDir>] #жҹҗзӣ®еҪ•е…Ғи®ёеҝ«з…§жүҚеҸҜд»ҘиҝӣиЎҢеҝ«з…§

[-disallowSnapshot <snapshotDir>]

[-shutdownDatanode <datanode_host:ipc_port> [upgrade]]

[-getDatanodeInfo <datanode_host:ipc_port>]

[-metasave filename] hadoop balancer [-threshold <threshold>] # зЈҒзӣҳе®№йҮҸзҡ„зҷҫеҲҶжҜ”

hdfsиҫҫеҲ°е№іиЎЎзҠ¶жҖҒиҫҫеҲ°зЈҒзӣҳдҪҝз”ЁзҺҮеҒҸе·®еҖјпјҢеҖји¶ҠдҪҺи¶Ҡе№іиЎЎпјҢдҪҶж¶ҲиҖ—ж—¶й—ҙд№ҹи¶Ҡй•ҝгҖӮ

[root@hadoop2 ~]# yarn rmadmin #resourcemanager е®ўжҲ·з«Ҝ

Usage: yarn rmadmin

-refreshQueues #йҮҚиҪҪйҳҹеҲ—зҡ„aclгҖҒзҠ¶жҖҒеҸҠи°ғеәҰеҷЁйҳҹеҲ—

-refreshNodes #дёәRMеҲ·ж–°дё»жңәдҝЎжҒҜ

-refreshSuperUserGroupsConfiguration

-refreshUserToGroupsMappings

-refreshAdminAcls

-refreshServiceAcl

-addToClusterNodeLabels [label1,label2,label3] (label splitted by ",")

-removeFromClusterNodeLabels [label1,label2,label3] (label splitted by ",")

-replaceLabelsOnNode [node1[:port]=label1,label2 node2[:port]=label1,label2]

-directlyAccessNodeLabelStore

-transitionToActive [--forceactive] <serviceId>#rmиҠӮзӮ№ж•…йҡңиҪ¬з§»

-transitionToStandby <serviceId>

-failover [--forcefence] [--forceactive] <serviceId> <serviceId>

-getServiceState <serviceId>#жЈҖжҹҘеҪ“еүҚrmзҠ¶жҖҒ

-checkHealth <serviceId>

-help [cmd]

hdfs namenode -format

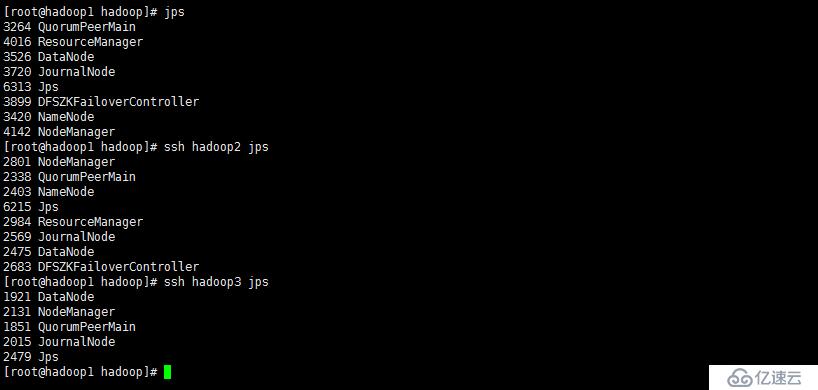

hadoop1пјҡhadoop-daemon.sh start namenode

hadoop2пјҡhdfs namenode -bootstrapStandby,еңЁеҗҜеҠЁnn

hdfs zkfc -formatZK

hadoop-daemon.sh start zkfc #жҠҠж•…йҡңиҪ¬з§»иҠӮзӮ№жңҚеҠЎеҗҜеҠЁпјҢеҗҰеҲҷеҪ“еүҚзҠ¶жҖҒйғҪдёәstandbyпјҒ

е…ҚиҙЈеЈ°жҳҺпјҡжң¬з«ҷеҸ‘еёғзҡ„еҶ…е®№пјҲеӣҫзүҮгҖҒи§Ҷйў‘е’Ңж–Үеӯ—пјүд»ҘеҺҹеҲӣгҖҒиҪ¬иҪҪе’ҢеҲҶдә«дёәдё»пјҢж–Үз« и§ӮзӮ№дёҚд»ЈиЎЁжң¬зҪ‘з«ҷз«ӢеңәпјҢеҰӮжһңж¶үеҸҠдҫөжқғиҜ·иҒ”зі»з«ҷй•ҝйӮ®з®ұпјҡis@yisu.comиҝӣиЎҢдёҫжҠҘпјҢ并жҸҗдҫӣзӣёе…іиҜҒжҚ®пјҢдёҖз»ҸжҹҘе®һпјҢе°Ҷз«ӢеҲ»еҲ йҷӨж¶үе«ҢдҫөжқғеҶ…е®№гҖӮ

жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ