您好,登录后才能下订单哦!

本文将介绍在Mac os上搭建Spark开发环境。

在安装spark环境之前,需要确保配置相应的java环境,jdk或者jre的版本需要在1.8.0版本以上。

(1)首先下载开发IDE,目前比较流行的IDE是IntelliJ IDEA,可以在官网下载使用,下载地址:https://www.jetbrains.com/idea/。

(2)Spark环境搭建:

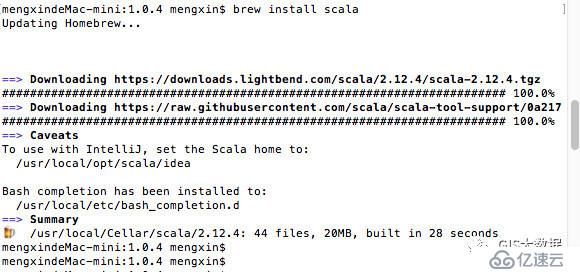

mac上启动终端,使用brew install scala命令(brew是一个软件包管理工具,类似于centos下的yum或者ubuntu下的apt-get),进行Scala的安装下载,如下:

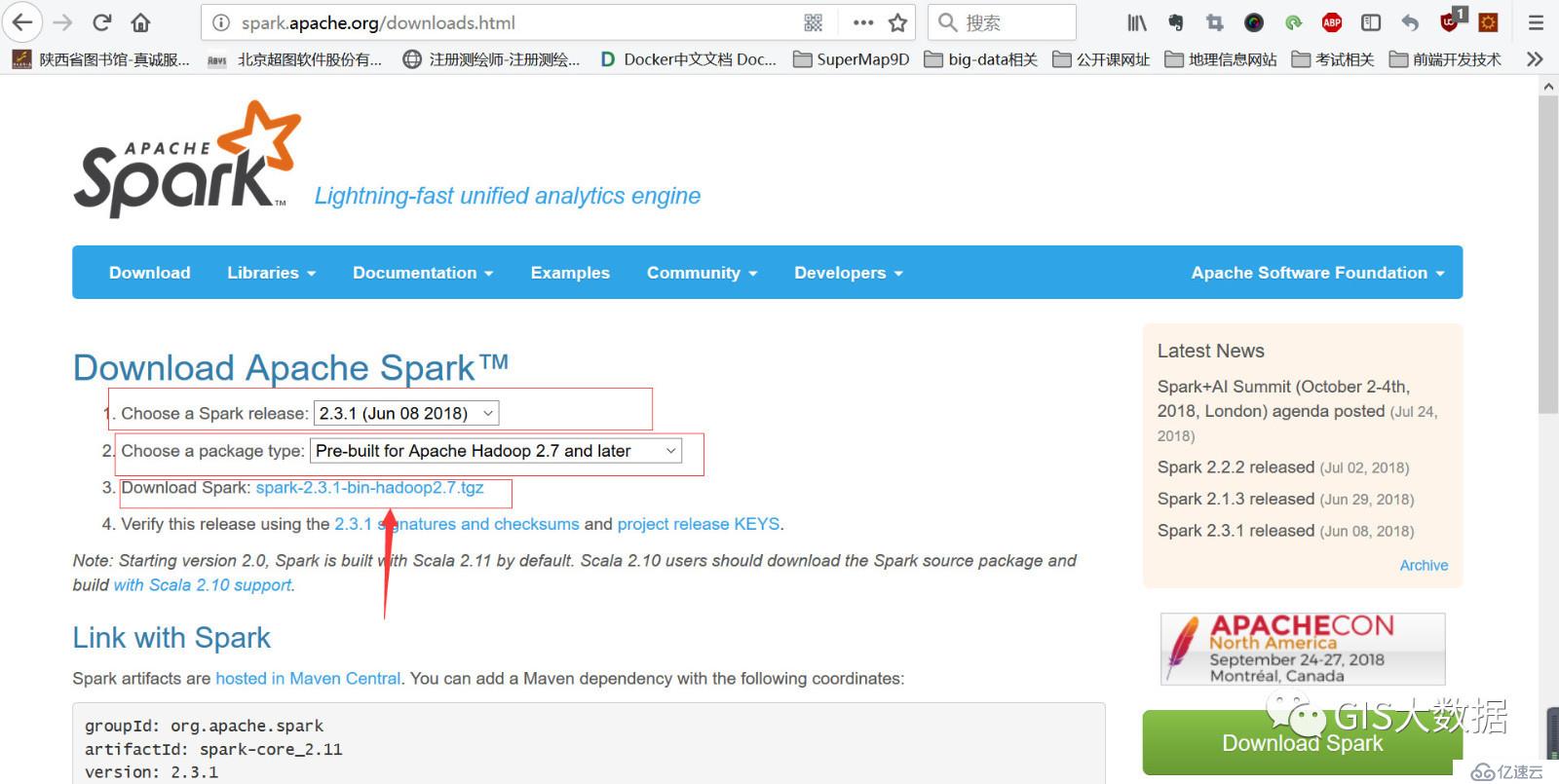

到此scala的环境已经安装成功,现在我们从spark的官网下载spark相关环境,网址为:http://spark.apache.org/

下载完spark,进入到下载的spark包的文件夹下,执行tar -zxvf spark-2.3.1-bin-hadoop2.7.tar。

安装完scala以及spark后,进行相关环境变量的配置,执行vim /etc/profile命令,在其后追加如下环境变量:

export SCALA_HOME=/usr/local/Cellar/scala/2.12.4

export PATH=$PATH:$SCALA_HOME/bin

export SPARK_HOME=/Users/mengxin/Downloads/spark-2.3.1-bin-hadoop2.7

export PATH=$PATH:$SPARK_HOME/bin

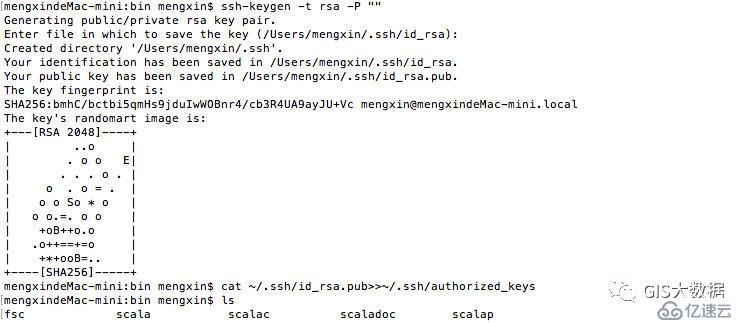

(3)进行本机ssh配置,主目录执行以下命令:

ssh-keygen -t rsa -P ""

cat ~/.ssh/id_rsa.pub>>~/.ssh/authorized_keys

执行过程如下:

(4)检测下spark是否能启动

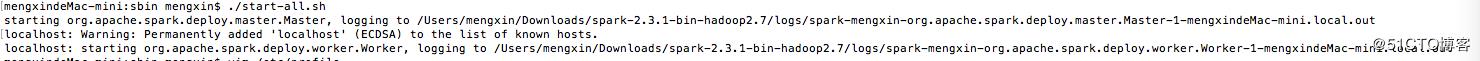

进入spark解压包下的sbin目录,执行./start-all.sh,如下图

可以在local.out文件下查看相关的启动情况。

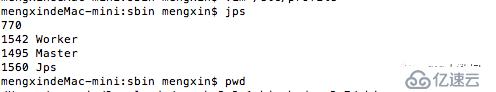

spark启动后,所启动的master以及worker进程其实就是就是jvm进程,我们可以用jps命令看一下。

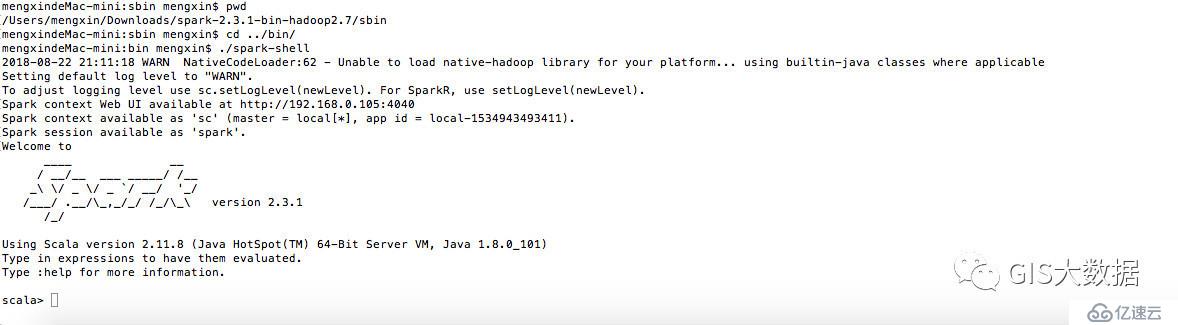

再用spark shell测试下,进入到spark安装包的bin目录下,如果出现如下界面,则说明spark安装环境已经大功告成了。

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。