жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ

жң¬зҜҮеҶ…е®№дё»иҰҒи®Іи§ЈвҖңеҹәдәҺPytorchеҰӮдҪ•е®һзҺ°йҖ»иҫ‘еӣһеҪ’вҖқпјҢж„ҹе…ҙи¶Јзҡ„жңӢеҸӢдёҚеҰЁжқҘзңӢзңӢгҖӮжң¬ж–Үд»Ӣз»Қзҡ„ж–№жі•ж“ҚдҪңз®ҖеҚ•еҝ«жҚ·пјҢе®һз”ЁжҖ§ејәгҖӮдёӢйқўе°ұи®©е°Ҹзј–жқҘеёҰеӨ§е®¶еӯҰд№ вҖңеҹәдәҺPytorchеҰӮдҪ•е®һзҺ°йҖ»иҫ‘еӣһеҪ’вҖқеҗ§!

1.йҖ»иҫ‘еӣһеҪ’

зәҝжҖ§еӣһеҪ’иЎЁйқўдёҠзңӢжҳҜвҖңеӣһеҪ’й—®йўҳвҖқпјҢе®һйҷ…дёҠеӨ„зҗҶзҡ„й—®йўҳжҳҜвҖңеҲҶзұ»вҖқй—®йўҳпјҢйҖ»иҫ‘еӣһеҪ’жЁЎеһӢжҳҜдёҖз§Қе№ҝд№үзҡ„еӣһеҪ’жЁЎеһӢпјҢе…¶дёҺзәҝжҖ§еӣһеҪ’жЁЎеһӢжңүеҫҲеӨҡзҡ„зӣёдјјд№ӢеӨ„пјҢжЁЎеһӢзҡ„еҪўејҸд№ҹеҹәжң¬зӣёеҗҢпјҢе”ҜдёҖдёҚеҗҢзҡ„ең°ж–№еңЁдәҺйҖ»иҫ‘еӣһеҪ’дјҡеҜ№yдҪңз”ЁдёҖдёӘйҖ»иҫ‘еҮҪж•°пјҢе°Ҷе…¶иҪ¬еҢ–дёәдёҖз§ҚжҰӮзҺҮзҡ„з»“жһңгҖӮйҖ»иҫ‘еҮҪж•°д№ҹз§°дёәSigmoidеҮҪж•°пјҢжҳҜйҖ»иҫ‘еӣһеҪ’зҡ„ж ёеҝғгҖӮ

2.еҹәдәҺPytorchе®һзҺ°йҖ»иҫ‘еӣһеҪ’

import torch as t

import matplotlib.pyplot as plt

from torch import nn

from torch.autograd import Variable

import numpy as np

# жһ„йҖ ж•°жҚ®йӣҶ

n_data = t.ones(100, 2)

# normalпјҲпјүиҝ”еӣһдёҖдёӘеј йҮҸпјҢеј йҮҸйҮҢйқўзҡ„йҡҸжңәж•°жҳҜд»Һзӣёдә’зӢ¬з«Ӣзҡ„жӯЈжҖҒеҲҶеёғдёӯйҡҸжңәз”ҹжҲҗзҡ„гҖӮ

x0 = t.normal(2*n_data, 1)

y0 = t.zeros(100)

x1 = t.normal(-2*n_data, 1)

y1 = t.ones(100)

# жҠҠж•°жҚ®з»ҷеҗҲ并д»ҘдёӢпјҢ并且数жҚ®зҡ„еҪўејҸеҝ…йЎ»жҳҜдёӢйқўеҪўејҸ

x = t.cat((x0, x1), 0).type(t.FloatTensor)

y = t.cat((y0, y1), 0).type(t.FloatTensor)

# и§ӮеҜҹеҲ¶йҖ зҡ„ж•°жҚ®

plt.scatter(x.data.numpy()[:, 0], x.data.numpy()[:, 1], c=y.data.numpy(), s=100, lw=0)

plt.show()

# е»әз«ӢйҖ»иҫ‘еӣһеҪ’

class LogisticRegression(nn.Module):

def __init__(self):

super(LogisticRegression, self).__init__()

self.lr = nn.Linear(2, 1)

self.sm = nn.Sigmoid()

def forward(self, x):

x = self.lr(x)

x = self.sm(x)

return x

# е®һдҫӢеҢ–

logistic_model = LogisticRegression()

# зңӢGPUжҳҜеҗҰеҸҜдҪҝз”ЁпјҢеҰӮжһңеҸҜд»ҘдҪҝз”ЁGPUеҗҰеҲҷдёҚдҪҝз”Ё

if t.cuda.is_available():

logistic_model.cuda()

# е®ҡд№үжҚҹеӨұеҮҪж•°е’ҢдјҳеҢ–еҮҪж•°

criterion = nn.BCELoss()

optimizer = t.optim.SGD(logistic_model.parameters(), lr=1e-3, momentum=0.9)

# и®ӯз»ғжЁЎеһӢ

for epoch in range(1000):

if t.cuda.is_available():

x_data = Variable(x).cuda()

y_data = Variable(y).cuda()

else:

x_data = Variable(x)

y_data = Variable(y)

out = logistic_model(x_data)

loss = criterion(out, y_data)

print_loss = loss.data.item()

# д»Ҙ0.5дёәйҳҲеҖјиҝӣиЎҢеҲҶзұ»

mask = out.ge(0.5).float()

# и®Ўз®—жӯЈзЎ®йў„жөӢж ·жң¬зҡ„дёӘж•°

correct = (mask==y_data).sum()

# и®Ўз®—зІҫеәҰ

acc = correct.item()/x_data.size(0)

optimizer.zero_grad()

loss.backward()

optimizer.step()

# жҜҸдёӘ200дёӘepochжү“еҚ°дёҖж¬ЎеҪ“еүҚзҡ„иҜҜе·®е’ҢзІҫеәҰ

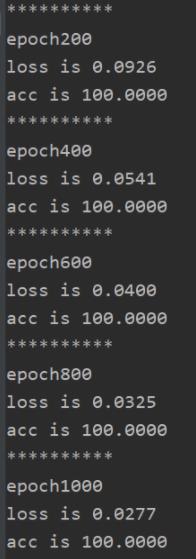

if(epoch+1)%200==0:

print('*'*10)

# иҝӯд»Јж¬Ўж•°

print('epoch{}'.format(epoch+1))

# иҜҜе·®

print('loss is {:.4f}'.format((print_loss)))

# зІҫеәҰ

print('acc is {:.4f}'.format(acc))

if __name__=="__main__":

logistic_model.eval()

w0, w1 = logistic_model.lr.weight[0]

w0 = float(w0.item())

w1 = float(w1.item())

b = float(logistic_model.lr.bias.item())

plot_x = np.arange(-7, 7, 0.1)

plot_y = (-w0*plot_x-b)/w1

plt.scatter(x.data.numpy()[:, 0], x.data.numpy()[:, 1], c=y.data.numpy(), s=100, lw=0)

plt.plot(plot_x, plot_y)

plt.show()

еҲ°жӯӨпјҢзӣёдҝЎеӨ§е®¶еҜ№вҖңеҹәдәҺPytorchеҰӮдҪ•е®һзҺ°йҖ»иҫ‘еӣһеҪ’вҖқжңүдәҶжӣҙж·ұзҡ„дәҶи§ЈпјҢдёҚеҰЁжқҘе®һйҷ…ж“ҚдҪңдёҖз•Әеҗ§пјҒиҝҷйҮҢжҳҜдәҝйҖҹдә‘зҪ‘з«ҷпјҢжӣҙеӨҡзӣёе…іеҶ…е®№еҸҜд»Ҙиҝӣе…Ҙзӣёе…ійў‘йҒ“иҝӣиЎҢжҹҘиҜўпјҢе…іжіЁжҲ‘们пјҢ继з»ӯеӯҰд№ пјҒ

е…ҚиҙЈеЈ°жҳҺпјҡжң¬з«ҷеҸ‘еёғзҡ„еҶ…е®№пјҲеӣҫзүҮгҖҒи§Ҷйў‘е’Ңж–Үеӯ—пјүд»ҘеҺҹеҲӣгҖҒиҪ¬иҪҪе’ҢеҲҶдә«дёәдё»пјҢж–Үз« и§ӮзӮ№дёҚд»ЈиЎЁжң¬зҪ‘з«ҷз«ӢеңәпјҢеҰӮжһңж¶үеҸҠдҫөжқғиҜ·иҒ”зі»з«ҷй•ҝйӮ®з®ұпјҡis@yisu.comиҝӣиЎҢдёҫжҠҘпјҢ并жҸҗдҫӣзӣёе…іиҜҒжҚ®пјҢдёҖз»ҸжҹҘе®һпјҢе°Ҷз«ӢеҲ»еҲ йҷӨж¶үе«ҢдҫөжқғеҶ…е®№гҖӮ

жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ