жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ

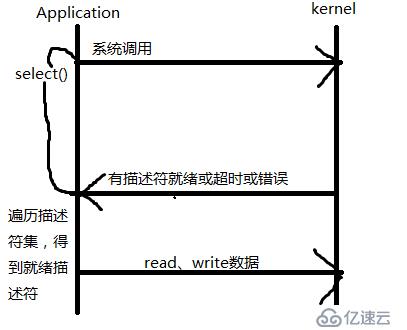

selectпјҢpollпјҢepollйғҪжҳҜIOеӨҡи·ҜеӨҚз”Ёзҡ„жңәеҲ¶гҖӮI/OеӨҡи·ҜеӨҚз”Ёе°ұйҖҡиҝҮдёҖз§ҚжңәеҲ¶пјҢеҸҜд»Ҙзӣ‘и§ҶеӨҡдёӘжҸҸиҝ°з¬ҰпјҢдёҖж—ҰжҹҗдёӘжҸҸиҝ°з¬Ұе°ұз»ӘпјҲдёҖиҲ¬жҳҜиҜ»е°ұз»ӘжҲ–иҖ…еҶҷе°ұз»ӘпјүпјҢиғҪеӨҹйҖҡзҹҘзЁӢеәҸиҝӣиЎҢзӣёеә”зҡ„иҜ»еҶҷж“ҚдҪңгҖӮдҪҶselectпјҢpollпјҢepollжң¬иҙЁдёҠйғҪжҳҜеҗҢжӯҘI/OпјҢеӣ дёә他们йғҪйңҖиҰҒеңЁиҜ»еҶҷдәӢ件е°ұз»ӘеҗҺиҮӘе·ұиҙҹиҙЈиҝӣиЎҢиҜ»еҶҷпјҢд№ҹе°ұжҳҜиҜҙиҝҷдёӘиҜ»еҶҷиҝҮзЁӢжҳҜйҳ»еЎһзҡ„пјҢиҖҢејӮжӯҘI/OеҲҷж— йңҖиҮӘе·ұиҙҹиҙЈиҝӣиЎҢиҜ»еҶҷпјҢејӮжӯҘI/Oзҡ„е®һзҺ°дјҡиҙҹиҙЈжҠҠж•°жҚ®д»ҺеҶ…ж ёжӢ·иҙқеҲ°з”ЁжҲ·з©әй—ҙгҖӮ

жӯӨж—¶йңҖзҹҘйҒ“дёӨдёӘжҰӮеҝөпјҡ

жүҖи°“йҳ»еЎһж–№ејҸblockпјҢйЎҫеҗҚжҖқд№үпјҢе°ұжҳҜиҝӣзЁӢжҲ–жҳҜзәҝзЁӢжү§иЎҢеҲ°иҝҷдәӣеҮҪж•°ж—¶еҝ…йЎ»зӯүеҫ…жҹҗдёӘдәӢ件зҡ„еҸ‘з”ҹпјҢеҰӮжһңдәӢ件没жңүеҸ‘з”ҹпјҢиҝӣзЁӢжҲ–зәҝзЁӢе°ұиў«йҳ»еЎһпјҢеҮҪж•°дёҚиғҪз«ӢеҚіиҝ”еӣһгҖӮ

жүҖи°“йқһйҳ»еЎһж–№ејҸnon-blockпјҢе°ұжҳҜиҝӣзЁӢжҲ–зәҝзЁӢжү§иЎҢжӯӨеҮҪж•°ж—¶дёҚеҝ…йқһиҰҒзӯүеҫ…дәӢ件зҡ„еҸ‘з”ҹпјҢдёҖж—Ұжү§иЎҢиӮҜе®ҡиҝ”еӣһпјҢд»Ҙиҝ”еӣһеҖјзҡ„дёҚеҗҢжқҘеҸҚжҳ еҮҪж•°зҡ„жү§иЎҢжғ…еҶөпјҢеҰӮжһңдәӢ件еҸ‘з”ҹеҲҷдёҺйҳ»еЎһж–№ејҸзӣёеҗҢпјҢиӢҘдәӢ件没жңүеҸ‘з”ҹпјҢеҲҷиҝ”еӣһдёҖдёӘд»Јз ҒжқҘе‘ҠзҹҘдәӢ件жңӘеҸ‘з”ҹпјҢиҖҢиҝӣзЁӢжҲ–зәҝзЁӢ继з»ӯжү§иЎҢпјҢжүҖд»Ҙж•ҲзҺҮиҫғй«ҳгҖӮ

дёҖ.select()зҡ„жңәеҲ¶дёӯжҸҗдҫӣдёҖfd_setзҡ„ж•°жҚ®з»“жһ„пјҢе®һйҷ…дёҠжҳҜдёҖlongзұ»еһӢзҡ„ж•°з»„пјҢ жҜҸдёҖдёӘж•°з»„е…ғзҙ йғҪиғҪдёҺдёҖжү“ејҖзҡ„ж–Ү件еҸҘжҹ„пјҲдёҚз®ЎжҳҜSocketеҸҘжҹ„пјҢиҝҳжҳҜе…¶д»– ж–Ү件жҲ–е‘ҪеҗҚз®ЎйҒ“жҲ–и®ҫеӨҮеҸҘжҹ„пјүе»әз«ӢиҒ”зі»пјҢе»әз«ӢиҒ”зі»зҡ„е·ҘдҪңз”ұзЁӢеәҸе‘ҳе®ҢжҲҗпјҢ еҪ“и°ғз”Ёselect()ж—¶пјҢз”ұеҶ…ж ёж №жҚ®IOзҠ¶жҖҒдҝ®ж”№fd_setзҡ„еҶ…е®№пјҢз”ұжӯӨжқҘйҖҡзҹҘжү§иЎҢдәҶselect()зҡ„иҝӣзЁӢе“ӘдёҖSocketжҲ–ж–Ү件еҸҜиҜ»жҲ–еҸҜеҶҷгҖӮдё»иҰҒз”ЁдәҺSocketйҖҡдҝЎеҪ“дёӯгҖӮ

selectдҪҝз”Ёпјҡе®ғиғҪеӨҹзӣ‘и§ҶжҲ‘们йңҖиҰҒзӣ‘и§Ҷзҡ„ж–Ү件жҸҸиҝ°з¬Ұзҡ„еҸҳеҢ–жғ…еҶөвҖ”вҖ”иҜ»еҶҷжҲ–жҳҜејӮеёёгҖӮеҮҶеӨҮе°ұз»Әзҡ„жҸҸиҝ°з¬Ұж•°пјҢиӢҘи¶…ж—¶еҲҷиҝ”еӣһ0пјҢиӢҘеҮәй”ҷеҲҷиҝ”еӣһ-1гҖӮ

1.еҰӮжһңдёҖдёӘеҸ‘зҺ°I/Oжңүиҫ“е…ҘпјҢиҜ»еҸ–зҡ„иҝҮзЁӢдёӯпјҢеҸҰеӨ–дёҖдёӘд№ҹжңүдәҶиҫ“е…ҘпјҢиҝҷж—¶еҖҷдёҚдјҡдә§з”ҹд»»дҪ•еҸҚеә”.иҝҷе°ұйңҖиҰҒдҪ зҡ„зЁӢеәҸиҜӯеҸҘеҺ»з”ЁеҲ°selectеҮҪж•°зҡ„ж—¶еҖҷжүҚзҹҘйҒ“жңүж•°жҚ®иҫ“е…ҘгҖӮ

2.зЁӢеәҸеҺ»selectзҡ„ж—¶еҖҷпјҢеҰӮжһңжІЎжңүж•°жҚ®иҫ“е…ҘпјҢзЁӢеәҸдјҡдёҖзӣҙзӯүеҫ…(йҳ»еЎһж—¶)пјҢзӣҙеҲ°жңүж•°жҚ®дёәжӯўпјҢд№ҹе°ұжҳҜзЁӢеәҸдёӯж— йңҖеҫӘзҺҜе’ҢsleepгҖӮ

#include <sys/types.h>

#include <sys/times.h>

#include <sys/select.h>

int select(int nfds, fd_set * readfds, fd_set * writefds, fd_set * exceptfds, struct timeval * timeout)

еҮҪж•°иҝ”еӣһз»“жһңпјҡеҪ“readfdsжҲ–writefdsдёӯжҳ иұЎзҡ„ж–Ү件еҸҜиҜ»жҲ–еҸҜеҶҷжҲ–и¶…ж—¶пјҢжң¬ж¬Ўselect()е°ұз»“жқҹиҝ”еӣһгҖӮзЁӢеәҸе‘ҳеҲ©з”ЁдёҖз»„зі»з»ҹжҸҗдҫӣзҡ„е®ҸеңЁselect()з»“жқҹж—¶дҫҝеҸҜеҲӨж–ӯе“ӘдёҖж–Ү件еҸҜиҜ»жҲ–еҸҜеҶҷпјҢеҜ№Socketзј–зЁӢзү№еҲ«жңүз”Ёзҡ„е°ұжҳҜreadfdsгҖӮ

жіЁпјҡдёҚеҗҢзҡ„timevalи®ҫзҪ®дҪҝselect()иЎЁзҺ°еҮәи¶…ж—¶з»“жқҹгҖҒж— и¶…ж—¶йҳ»еЎһе’ҢиҪ®иҜўдёүз§Қзү№жҖ§пјҲtimevalеҸҜзІҫзЎ®иҮізҷҫдёҮеҲҶд№ӢдёҖз§’пјүгҖӮ

selectиҜҰз»Ҷжү§иЎҢжӯҘйӘӨпјҡ

пјҲ1пјүдҪҝз”Ёcopy_from_userд»Һз”ЁжҲ·з©әй—ҙжӢ·иҙқfd_setеҲ°еҶ…ж ёз©әй—ҙ

пјҲ2пјүжіЁеҶҢеӣһи°ғеҮҪж•°__pollwait

пјҲ3пјүйҒҚеҺҶжүҖжңүfdпјҢи°ғз”Ёе…¶еҜ№еә”зҡ„pollж–№жі•пјҲеҜ№дәҺsocketпјҢиҝҷдёӘpollж–№жі•жҳҜsock_pollпјҢsock_pollж №жҚ®жғ…еҶөдјҡи°ғз”ЁеҲ°tcp_poll,udp_pollжҲ–иҖ…datagram_pollпјү

пјҲ4пјүд»Ҙtcp_pollдёәдҫӢпјҢе…¶ж ёеҝғе®һзҺ°е°ұжҳҜ__pollwaitпјҢд№ҹе°ұжҳҜдёҠйқўжіЁеҶҢзҡ„еӣһи°ғеҮҪж•°гҖӮ

пјҲ5пјү__pollwaitзҡ„дё»иҰҒе·ҘдҪңе°ұжҳҜжҠҠcurrentпјҲеҪ“еүҚиҝӣзЁӢпјүжҢӮеҲ°и®ҫеӨҮзҡ„зӯүеҫ…йҳҹеҲ—дёӯпјҢдёҚеҗҢзҡ„и®ҫеӨҮжңүдёҚеҗҢзҡ„зӯүеҫ…йҳҹеҲ—пјҢеҜ№дәҺtcp_pollжқҘиҜҙпјҢе…¶зӯүеҫ…йҳҹеҲ—жҳҜsk->sk_sleepпјҲжіЁж„ҸжҠҠиҝӣзЁӢжҢӮеҲ°зӯүеҫ…йҳҹеҲ—дёӯ并дёҚд»ЈиЎЁиҝӣзЁӢе·Із»ҸзқЎзң дәҶпјүгҖӮеңЁи®ҫеӨҮ收еҲ°дёҖжқЎж¶ҲжҒҜпјҲзҪ‘з»ңи®ҫеӨҮпјүжҲ–еЎ«еҶҷе®Ңж–Ү件数жҚ®пјҲзЈҒзӣҳи®ҫеӨҮпјүеҗҺпјҢдјҡе”ӨйҶ’и®ҫеӨҮзӯүеҫ…йҳҹеҲ—дёҠзқЎзң зҡ„иҝӣзЁӢпјҢиҝҷж—¶currentдҫҝиў«е”ӨйҶ’дәҶгҖӮ

пјҲ6пјүpollж–№жі•иҝ”еӣһж—¶дјҡиҝ”еӣһдёҖдёӘжҸҸиҝ°иҜ»еҶҷж“ҚдҪңжҳҜеҗҰе°ұз»Әзҡ„maskжҺ©з ҒпјҢж №жҚ®иҝҷдёӘmaskжҺ©з Ғз»ҷfd_setиөӢеҖјгҖӮ

пјҲ7пјүеҰӮжһңйҒҚеҺҶе®ҢжүҖжңүзҡ„fdпјҢиҝҳжІЎжңүиҝ”еӣһдёҖдёӘеҸҜиҜ»еҶҷзҡ„maskжҺ©з ҒпјҢеҲҷдјҡи°ғз”Ёschedule_timeoutжҳҜи°ғз”Ёselectзҡ„иҝӣзЁӢпјҲд№ҹе°ұжҳҜcurrentпјүиҝӣе…ҘзқЎзң гҖӮеҪ“и®ҫеӨҮй©ұеҠЁеҸ‘з”ҹиҮӘиә«иө„жәҗеҸҜиҜ»еҶҷеҗҺпјҢдјҡе”ӨйҶ’е…¶зӯүеҫ…йҳҹеҲ—дёҠзқЎзң зҡ„иҝӣзЁӢгҖӮеҰӮжһңи¶…иҝҮдёҖе®ҡзҡ„и¶…ж—¶ж—¶й—ҙпјҲschedule_timeoutжҢҮе®ҡпјүпјҢиҝҳжҳҜжІЎдәәе”ӨйҶ’пјҢеҲҷи°ғз”Ёselectзҡ„иҝӣзЁӢдјҡйҮҚж–°иў«е”ӨйҶ’иҺ·еҫ—CPUпјҢиҝӣиҖҢйҮҚж–°йҒҚеҺҶfdпјҢеҲӨж–ӯжңүжІЎжңүе°ұз»Әзҡ„fdгҖӮ

пјҲ8пјүжҠҠfd_setд»ҺеҶ…ж ёз©әй—ҙжӢ·иҙқеҲ°з”ЁжҲ·з©әй—ҙгҖӮ

д»Һд»ҘдёҠе·ҘдҪңжөҒзЁӢеҸҜеҫ—еҲ°selectзү№зӮ№пјҡ

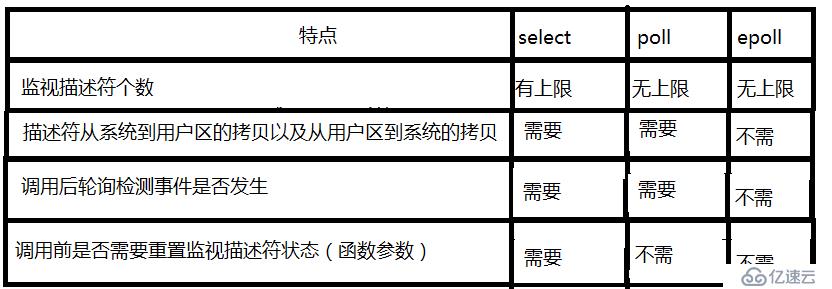

a.жүҖзӣ‘и§Ҷзҡ„жҜҸз§ҚдәӢ件жҸҸиҝ°з¬ҰдёӘж•°жңүдёҠйҷҗпјӣ

printf("%d\n",sizeof(fd_set));жҲ‘зҡ„linuxзі»з»ҹжүҖиғҪе…іеҝғдәӢ件еә”дёә128еӯ—иҠӮ*8=1024дёӘжҸҸиҝ°з¬Ұ

b.и°ғз”ЁеүҚеҗҺиҪ®иҜўпјӣ

дҪҝз”ЁselectеҮҪж•°пјҢеҝ…йЎ»дҪҝз”Ёиҫ…еҠ©ж•°з»„дҝқеӯҳе…іеҝғзҡ„жҸҸиҝ°з¬ҰпјҢеӣ дёәselectеҮҪж•°дёӯжҸҸиҝ°з¬ҰйӣҶжҳҜиҫ“е…Ҙиҫ“еҮәеһӢеҸӮж•°пјҢж•…еңЁи°ғз”ЁеүҚеә”иҪ®иҜўж•°з»„йҮҚзҪ®жҸҸиҝ°з¬ҰйӣҶпјҢи°ғз”ЁеҗҺеҫ—иҪ®иҜўжҸҸиҝ°з¬ҰйӣҶеҲӨж–ӯе…іеҝғдәӢ件жҳҜеҗҰе°ұз»ӘгҖӮ

c.зі»з»ҹдёҺз”ЁжҲ·ж•°жҚ®жӢ·иҙқпјҡдҪҝз”Ёcopy_from_userд»Һз”ЁжҲ·з©әй—ҙжӢ·иҙқfd_setеҲ°еҶ…ж ёз©әй—ҙгҖӮ

d.и°ғз”ЁеүҚйңҖйҮҚзҪ®пјҲжҸҸиҝ°з¬ҰйӣҶжҳҜиҫ“е…Ҙиҫ“еҮәеһӢеҸӮж•°пјүгҖӮ

дәҢ.poll:

pollзҡ„е®һзҺ°е’ҢselectйқһеёёзӣёдјјпјҢеҸӘжҳҜжҸҸиҝ°fdйӣҶеҗҲзҡ„ж–№ејҸдёҚеҗҢпјҢpollдҪҝз”Ёpollfdз»“жһ„иҖҢдёҚжҳҜselectзҡ„fd_setз»“жһ„пјҢе…¶д»–зҡ„йғҪе·®дёҚеӨҡгҖӮ

#include <poll.h>

int poll(struct pollfd fds[], nfds_t nfds, int timeout)пјӣ

зӣ‘и§ҶжҸҸиҝ°з¬ҰдәӢ件йҖүйЎ№пјҡ

fdsпјҡжҳҜдёҖдёӘstruct pollfdз»“жһ„зұ»еһӢзҡ„ж•°з»„пјҢз”ЁдәҺеӯҳж”ҫйңҖиҰҒжЈҖжөӢе…¶зҠ¶жҖҒзҡ„SocketжҸҸиҝ°з¬ҰпјӣжҜҸеҪ“и°ғз”ЁиҝҷдёӘеҮҪж•°д№ӢеҗҺпјҢзі»з»ҹдёҚдјҡжё…з©әиҝҷдёӘж•°з»„пјҢж“ҚдҪңиө·жқҘжҜ”иҫғж–№дҫҝпјӣзү№еҲ«жҳҜеҜ№дәҺsocketиҝһжҺҘжҜ”иҫғеӨҡзҡ„жғ…еҶөдёӢпјҢеңЁдёҖе®ҡзЁӢеәҰдёҠеҸҜд»ҘжҸҗй«ҳеӨ„зҗҶзҡ„ж•ҲзҺҮпјӣиҝҷдёҖзӮ№дёҺselect()еҮҪж•°дёҚеҗҢпјҢи°ғз”Ёselect()еҮҪж•°д№ӢеҗҺпјҢselect()еҮҪж•°дјҡжё…з©әе®ғжүҖжЈҖжөӢзҡ„socketжҸҸиҝ°з¬ҰйӣҶеҗҲпјҢеҜјиҮҙжҜҸж¬Ўи°ғз”Ёselect()д№ӢеүҚйғҪеҝ…йЎ»жҠҠsocketжҸҸиҝ°з¬ҰйҮҚж–°еҠ е…ҘеҲ°еҫ…жЈҖжөӢзҡ„йӣҶеҗҲдёӯпјӣеӣ жӯӨпјҢselect()еҮҪж•°йҖӮеҗҲдәҺеҸӘжЈҖжөӢдёҖдёӘsocketжҸҸиҝ°з¬Ұзҡ„жғ…еҶөпјҢиҖҢpoll()еҮҪж•°йҖӮеҗҲдәҺеӨ§йҮҸsocketжҸҸиҝ°з¬Ұзҡ„жғ…еҶөпјӣдёҺselect()еҚҒеҲҶзӣёдјјпјҢеҪ“иҝ”еӣһжӯЈеҖјж—¶пјҢд»ЈиЎЁж»Ўи¶іе“Қеә”дәӢ件зҡ„ж–Ү件жҸҸиҝ°з¬Ұзҡ„дёӘж•°пјҢеҰӮжһңиҝ”еӣһ0еҲҷд»ЈиЎЁеңЁи§„е®ҡж—¶й—ҙеҶ…жІЎжңүдәӢ件еҸ‘з”ҹгҖӮеҰӮеҸ‘зҺ°иҝ”еӣһдёәиҙҹеҲҷеә”иҜҘз«ӢеҚіжҹҘзңӢ errnoпјҢеӣ дёәиҝҷд»ЈиЎЁжңүй”ҷиҜҜеҸ‘з”ҹгҖӮ

жіЁпјҡеҰӮжһңжІЎжңүдәӢ件еҸ‘з”ҹпјҢreventsдјҡиў«жё…з©әгҖӮ

pollзү№зӮ№пјҡ

зӣ‘и§ҶжҸҸиҝ°з¬ҰдёӘж•°ж— дёҠйҷҗпјӣ

жңҖеӨ§жҸҸиҝ°з¬Ұ+1пјҢдёӘж•°з”ұfdsж•°з»„еҶіе®ҡгҖӮ

2.зӣ‘и§ҶдәӢ件дёҺиҝ”еӣһеҗҺдәӢ件зҠ¶жҖҒеҸҚз”ҹеҲҶзҰ»пјҢи°ғз”ЁеүҚеҗҺдёҚйңҖйҮҚзҪ®гҖӮ

3.и°ғз”ЁеҗҺиҪ®иҜўжЈҖжөӢзӣ‘и§ҶдәӢ件жҳҜеҗҰеҸ‘з”ҹгҖӮ

4.зі»з»ҹдёҺз”ЁжҲ·ж•°жҚ®жӢ·иҙқпјҡдҪҝз”Ёcopy_from_userд»Һз”ЁжҲ·з©әй—ҙжӢ·иҙқfdsеҲ°еҶ…ж ёз©әй—ҙ

дёү.epoll.

epollжҳҜlinuxеҶ…ж ёдёәеӨ„зҗҶеӨ§жү№йҮҸж–Ү件жҸҸиҝ°з¬ҰиҖҢдҪңдәҶж”№иҝӣзҡ„pollпјҢжҳҜLinuxдёӢеӨҡи·ҜеӨҚз”ЁIOжҺҘеҸЈselect/pollзҡ„еўһејәзүҲжң¬пјҢе®ғиғҪжҳҫи‘—жҸҗй«ҳзЁӢеәҸеңЁеӨ§йҮҸ并еҸ‘иҝһжҺҘдёӯдёӯеҸӘжңүе°‘йҮҸжҙ»и·ғзҡ„жғ…еҶөдёӢзҡ„зі»з»ҹCPUеҲ©з”ЁзҺҮгҖӮеҸҰдёҖзӮ№еҺҹеӣ е°ұжҳҜиҺ·еҸ–дәӢ件зҡ„ж—¶еҖҷпјҢе®ғж— йЎ»йҒҚеҺҶж•ҙдёӘиў«дҫҰеҗ¬зҡ„жҸҸиҝ°з¬ҰйӣҶпјҢеҸӘиҰҒйҒҚеҺҶйӮЈдәӣиў«еҶ…ж ёIOдәӢ件ејӮжӯҘе”ӨйҶ’иҖҢеҠ е…ҘReadyйҳҹеҲ—зҡ„жҸҸиҝ°з¬ҰйӣҶеҗҲе°ұиЎҢдәҶгҖӮepollйҷӨдәҶжҸҗдҫӣselect/pollйӮЈз§ҚIOдәӢ件зҡ„ж°ҙе№іи§ҰеҸ‘пјҲLevel TriggeredпјүеӨ–пјҢиҝҳжҸҗдҫӣдәҶиҫ№зјҳи§ҰеҸ‘пјҲEdge TriggeredпјүпјҢиҝҷе°ұдҪҝеҫ—з”ЁжҲ·з©әй—ҙзЁӢеәҸжңүеҸҜиғҪзј“еӯҳIOзҠ¶жҖҒпјҢеҮҸе°‘epoll_wait/epoll_pwaitзҡ„и°ғз”ЁпјҢжҸҗй«ҳеә”з”ЁзЁӢеәҸж•ҲзҺҮгҖӮ

epollзү№зӮ№пјҡ

1.epollе’Ңselectе’Ңpollзҡ„и°ғз”ЁжҺҘеҸЈдёҠзҡ„дёҚеҗҢгҖӮ

selectе’ҢpollйғҪеҸӘжҸҗдҫӣдәҶдёҖдёӘеҮҪж•°вҖ”вҖ”selectжҲ–иҖ…pollеҮҪж•°гҖӮиҖҢepollжҸҗдҫӣдәҶдёүдёӘеҮҪж•°пјҢepoll_create,epoll_ctlе’Ңepoll_waitпјҢepoll_createжҳҜеҲӣе»әдёҖдёӘepollеҸҘжҹ„пјӣepoll_ctlжҳҜжіЁеҶҢиҰҒзӣ‘еҗ¬зҡ„дәӢ件зұ»еһӢпјӣepoll_waitеҲҷжҳҜзӯүеҫ…дәӢ件зҡ„дә§з”ҹгҖӮ

2.дҪҝз”ЁmmapеҠ йҖҹеҶ…ж ёдёҺз”ЁжҲ·з©әй—ҙзҡ„ж¶ҲжҒҜдј йҖ’гҖӮ

еҜ№дәҺselectе’ҢpollеҮҪж•°зҡ„зі»з»ҹдёҺеҶ…ж ёжҜҸж¬Ўи°ғз”Ёж—¶зҡ„ж•°жҚ®жӢ·иҙқпјҡepollжҳҜйҖҡиҝҮеҶ…ж ёдёҺз”ЁжҲ·з©әй—ҙmmapеҗҢдёҖеқ—еҶ…еӯҳе®һзҺ°зҡ„пјҢеңЁepoll_ctlеҮҪж•°дёӯпјҡжҜҸж¬ЎжіЁеҶҢж–°зҡ„дәӢ件еҲ°epollеҸҘжҹ„дёӯж—¶пјҲеңЁepoll_ctlдёӯжҢҮе®ҡEPOLL_CTL_ADDпјүпјҢдјҡжҠҠжүҖжңүзҡ„fdжӢ·иҙқиҝӣеҶ…ж ёпјҢиҖҢдёҚжҳҜеңЁepoll_waitзҡ„ж—¶еҖҷйҮҚеӨҚжӢ·иҙқгҖӮepollдҝқиҜҒдәҶжҜҸдёӘfdеңЁж•ҙдёӘиҝҮзЁӢдёӯеҸӘдјҡжӢ·иҙқдёҖж¬ЎгҖӮ

3.и°ғз”ЁеҗҺдёҚйңҖиҪ®иҜўеҲӨж–ӯжҸҸиҝ°з¬ҰдәӢ件жҳҜеҗҰе°ұз»ӘгҖӮ

еҜ№дәҺselectе’ҢpollеҮҪж•°жҜҸж¬Ўи°ғз”ЁеҗҺиҪ®иҜўжЈҖжөӢдәӢ件жҳҜеҗҰеҸ‘з”ҹпјҡepollзҡ„и§ЈеҶіж–№жЎҲдёҚеғҸselectжҲ–pollдёҖж ·жҜҸж¬ЎйғҪжҠҠcurrentиҪ®жөҒеҠ е…ҘfdеҜ№еә”зҡ„и®ҫеӨҮзӯүеҫ…йҳҹеҲ—дёӯпјҢиҖҢеҸӘеңЁepoll_ctlж—¶жҠҠcurrentжҢӮдёҖйҒҚпјҲиҝҷдёҖйҒҚеҝ…дёҚеҸҜе°‘пјү并дёәжҜҸдёӘfdжҢҮе®ҡдёҖдёӘеӣһи°ғеҮҪж•°пјҢеҪ“и®ҫеӨҮе°ұз»ӘпјҢе”ӨйҶ’зӯүеҫ…йҳҹеҲ—дёҠзҡ„зӯүеҫ…иҖ…ж—¶пјҢе°ұдјҡи°ғз”ЁиҝҷдёӘеӣһи°ғеҮҪж•°пјҢиҖҢиҝҷдёӘеӣһи°ғеҮҪж•°дјҡжҠҠе°ұз»Әзҡ„fdеҠ е…ҘдёҖдёӘе°ұз»Әй“ҫиЎЁпјүгҖӮepoll_waitзҡ„е·ҘдҪңе®һйҷ…дёҠе°ұжҳҜеңЁиҝҷдёӘе°ұз»Әй“ҫиЎЁдёӯжҹҘзңӢжңүжІЎжңүе°ұз»Әзҡ„fdпјҲеҲ©з”Ёschedule_timeout()е®һзҺ°зқЎдёҖдјҡпјҢеҲӨж–ӯдёҖдјҡзҡ„ж•ҲжһңпјүгҖӮ

4.зӣ‘и§ҶжҸҸиҝ°з¬ҰжІЎжңүдёӘж•°дёҠйҷҗгҖӮ

epollжІЎжңүиҝҷдёӘйҷҗеҲ¶пјҢе®ғжүҖж”ҜжҢҒзҡ„FDдёҠйҷҗжҳҜжңҖеӨ§еҸҜд»Ҙжү“ејҖж–Ү件зҡ„ж•°зӣ®пјҢиҝҷдёӘж•°еӯ—дёҖиҲ¬иҝңеӨ§дәҺ2048,жіЁпјҡеңЁ1GBеҶ…еӯҳзҡ„жңәеҷЁдёҠеӨ§зәҰжҳҜ10дёҮе·ҰеҸіпјҢе…·дҪ“ж•°зӣ®еҸҜд»Ҙcat /proc/sys/fs/file-maxеҜҹзңӢ,дёҖиҲ¬жқҘиҜҙиҝҷдёӘж•°зӣ®е’Ңзі»з»ҹеҶ…еӯҳе…ізі»еҫҲеӨ§гҖӮ

5.IOж•ҲзҺҮдёҚйҡҸFDж•°зӣ®еўһеҠ иҖҢзәҝжҖ§дёӢйҷҚгҖӮ

дј з»ҹзҡ„select/pollеҸҰдёҖдёӘиҮҙе‘ҪејұзӮ№е°ұжҳҜеҪ“дҪ жӢҘжңүдёҖдёӘеҫҲеӨ§зҡ„socketйӣҶеҗҲпјҢдёҚиҝҮз”ұдәҺзҪ‘з»ң延时пјҢд»»дёҖж—¶й—ҙеҸӘжңүйғЁеҲҶзҡ„socketжҳҜвҖңжҙ»и·ғвҖқзҡ„пјҢдҪҶжҳҜselect/pollжҜҸж¬Ўи°ғз”ЁйғҪдјҡзәҝжҖ§жү«жҸҸе…ЁйғЁзҡ„йӣҶеҗҲпјҢеҜјиҮҙж•ҲзҺҮе‘ҲзҺ°зәҝжҖ§дёӢйҷҚгҖӮдҪҶжҳҜepollдёҚеӯҳеңЁиҝҷдёӘй—®йўҳпјҢе®ғеҸӘдјҡеҜ№вҖңжҙ»и·ғвҖқзҡ„socketиҝӣиЎҢж“ҚдҪң---иҝҷжҳҜеӣ дёәеңЁеҶ…ж ёе®һзҺ°дёӯepollжҳҜж №жҚ®жҜҸдёӘfdдёҠйқўзҡ„callbackеҮҪж•°е®һзҺ°зҡ„гҖӮеҸӘжңүвҖңжҙ»и·ғвҖқзҡ„socketжүҚдјҡдё»еҠЁзҡ„еҺ»и°ғз”Ё callbackеҮҪж•°пјҢе…¶д»–idleзҠ¶жҖҒsocketеҲҷдёҚдјҡгҖӮ

жӢ“еұ•пјҡзі»з»ҹз»ҙжҠӨдёҖйў—зәўй»‘ж ‘пјҲе№іиЎЎжҗңзҙўдәҢеҸүж ‘пјҡзЁіе®ҡпјүеӯҳеӮЁзӣ‘и§ҶжҸҸиҝ°з¬ҰпјҢе’ҢдёҖеј й“ҫиЎЁеӯҳеӮЁе°ұз»Әзҡ„жҸҸиҝ°з¬ҰгҖӮеҪ“жҜҸж¬ЎжіЁеҶҢжҲ–дҝ®ж”№пјҢеҲ йҷӨж–°зҡ„ж–Ү件жҸҸиҝ°з¬ҰеҲ°epollеҸҘжҹ„дёӯж—¶пјҢе°ұдјҡеўһеҠ дёҖдёӘжҸҸиҝ°з¬ҰеҲ°иҝҷиҜҫзәўй»‘ж ‘дёӯпјҲеўһеҲ ж”№жҹҘз®ҖеҚ•пјүпјҢеҪ“иҝ”еӣһж—¶жЈҖжөӢй“ҫиЎЁдёҠжҳҜеҗҰжңүиҠӮзӮ№пјҢжңүиҠӮзӮ№еҲҷжӢ·иҙқеҲ°з”ЁжҲ·дј з»ҷе®ғзҡ„йӮЈдёӘжҸҸиҝ°з¬Ұж•°з»„дёӯгҖӮ

epollеҜ№дәҺselectе’ҢpollзӣёжҜ”пјҢжҳҫи‘—дјҳзӮ№жҳҜпјҡ

пјҲ1пјүselectпјҢpollе®һзҺ°йңҖиҰҒиҮӘе·ұдёҚж–ӯиҪ®иҜўжүҖжңүfdйӣҶеҗҲпјҢзӣҙеҲ°и®ҫеӨҮе°ұз»ӘпјҢжңҹй—ҙеҸҜиғҪиҰҒзқЎзң е’Ңе”ӨйҶ’еӨҡж¬ЎдәӨжӣҝгҖӮиҖҢepollе…¶е®һд№ҹйңҖиҰҒи°ғз”Ёepoll_waitдёҚж–ӯиҪ®иҜўе°ұз»Әй“ҫиЎЁпјҢжңҹй—ҙд№ҹеҸҜиғҪеӨҡж¬ЎзқЎзң е’Ңе”ӨйҶ’дәӨжӣҝпјҢдҪҶжҳҜе®ғжҳҜи®ҫеӨҮе°ұз»Әж—¶пјҢи°ғз”Ёеӣһи°ғеҮҪж•°пјҢжҠҠе°ұз»Әfdж”ҫе…Ҙе°ұз»Әй“ҫиЎЁдёӯпјҢ并е”ӨйҶ’еңЁepoll_waitдёӯиҝӣе…ҘзқЎзң зҡ„иҝӣзЁӢгҖӮиҷҪ然йғҪиҰҒзқЎзң е’ҢдәӨжӣҝпјҢдҪҶжҳҜselectе’ҢpollеңЁвҖңйҶ’зқҖвҖқзҡ„ж—¶еҖҷиҰҒйҒҚеҺҶж•ҙдёӘfdйӣҶеҗҲпјҢиҖҢepollеңЁвҖңйҶ’зқҖвҖқзҡ„ж—¶еҖҷеҸӘиҰҒеҲӨж–ӯдёҖдёӢе°ұз»Әй“ҫиЎЁжҳҜеҗҰдёәз©әе°ұиЎҢдәҶпјҢиҝҷиҠӮзңҒдәҶеӨ§йҮҸзҡ„CPUж—¶й—ҙгҖӮиҝҷе°ұжҳҜеӣһи°ғжңәеҲ¶еёҰжқҘзҡ„жҖ§иғҪжҸҗеҚҮгҖӮ

пјҲ2пјүselectпјҢpollжҜҸж¬Ўи°ғз”ЁйғҪиҰҒжҠҠfdйӣҶеҗҲд»Һз”ЁжҲ·жҖҒеҫҖеҶ…ж ёжҖҒжӢ·иҙқдёҖж¬ЎпјҢ并且иҰҒжҠҠcurrentеҫҖи®ҫеӨҮзӯүеҫ…йҳҹеҲ—дёӯжҢӮдёҖж¬ЎпјҢиҖҢepollеҸӘиҰҒдёҖж¬ЎжӢ·иҙқпјҢиҖҢдё”жҠҠcurrentеҫҖзӯүеҫ…йҳҹеҲ—дёҠжҢӮд№ҹеҸӘжҢӮдёҖж¬ЎпјҲеңЁepoll_waitзҡ„ејҖе§ӢпјҢжіЁж„ҸиҝҷйҮҢзҡ„зӯүеҫ…йҳҹеҲ—并дёҚжҳҜи®ҫеӨҮзӯүеҫ…йҳҹеҲ—пјҢеҸӘжҳҜдёҖдёӘepollеҶ…йғЁе®ҡд№үзҡ„зӯүеҫ…йҳҹеҲ—пјүгҖӮиҝҷд№ҹиғҪиҠӮзңҒдёҚе°‘зҡ„ејҖй”ҖгҖӮ

жҖ»з»“пјҡ

select

selectиғҪзӣ‘жҺ§зҡ„жҸҸиҝ°з¬ҰдёӘж•°з”ұеҶ…ж ёдёӯзҡ„FD_SETSIZEйҷҗеҲ¶пјҢд»…дёә1024пјҢиҝҷд№ҹжҳҜselectжңҖеӨ§зҡ„зјәзӮ№пјҢеӣ дёәзҺ°еңЁзҡ„жңҚеҠЎеҷЁе№¶еҸ‘йҮҸиҝңиҝңдёҚжӯў1024гҖӮеҚідҪҝиғҪйҮҚж–°зј–иҜ‘еҶ…ж ёж”№еҸҳFD_SETSIZEзҡ„еҖјпјҢдҪҶиҝҷ并дёҚиғҪжҸҗй«ҳ selectзҡ„жҖ§иғҪгҖӮ

жҜҸж¬Ўи°ғз”ЁselectйғҪдјҡзәҝжҖ§жү«жҸҸжүҖжңүжҸҸиҝ°з¬Ұзҡ„зҠ¶жҖҒпјҢеңЁselectз»“жқҹеҗҺпјҢз”ЁжҲ·д№ҹиҰҒзәҝжҖ§жү«жҸҸfd_setж•°з»„жүҚзҹҘйҒ“е“ӘдәӣжҸҸиҝ°з¬ҰеҮҶеӨҮе°ұз»ӘпјҢзӯүдәҺиҜҙжҜҸж¬Ўи°ғз”ЁеӨҚжқӮеәҰйғҪжҳҜOпјҲnпјүзҡ„пјҢеңЁе№¶еҸ‘йҮҸеӨ§зҡ„жғ…еҶөдёӢпјҢжҜҸж¬Ўжү«жҸҸйғҪжҳҜзӣёеҪ“иҖ—ж—¶зҡ„пјҢеҫҲжңүеҸҜиғҪжңүжңӘеӨ„зҗҶзҡ„иҝһжҺҘзӯүеҫ…и¶…ж—¶гҖӮ

жҜҸж¬Ўи°ғз”ЁselectйғҪиҰҒеңЁз”ЁжҲ·з©әй—ҙе’ҢеҶ…ж ёз©әй—ҙйҮҢиҝӣиЎҢеҶ…еӯҳеӨҚеҲ¶fdжҸҸиҝ°з¬ҰзӯүдҝЎжҒҜгҖӮ

pollдҪҝз”Ёpollfdз»“жһ„жқҘеӯҳеӮЁfdпјҢзӘҒз ҙдәҶselectдёӯжҸҸиҝ°з¬Ұж•°зӣ®зҡ„йҷҗеҲ¶гҖӮ

дёҺselectзҡ„еҗҺдёӨзӮ№зұ»дјјпјҢpollд»Қ然йңҖиҰҒе°Ҷpollfdж•°з»„жӢ·иҙқеҲ°еҶ…ж ёз©әй—ҙпјҢд№ӢеҗҺдҫқж¬Ўжү«жҸҸfdзҡ„зҠ¶жҖҒпјҢж•ҙдҪ“еӨҚжқӮеәҰдҫқ然жҳҜOпјҲnпјүзҡ„пјҢеңЁе№¶еҸ‘йҮҸеӨ§зҡ„жғ…еҶөдёӢжңҚеҠЎеҷЁжҖ§иғҪдјҡеҝ«йҖҹдёӢйҷҚгҖӮ

epollз»ҙжҠӨзҡ„жҸҸиҝ°з¬Ұж•°зӣ®дёҚеҸ—еҲ°йҷҗеҲ¶пјҢиҖҢдё”жҖ§иғҪдёҚдјҡйҡҸзқҖжҸҸиҝ°з¬Ұж•°зӣ®зҡ„еўһеҠ иҖҢдёӢйҷҚгҖӮ

жңҚеҠЎеҷЁзҡ„зү№зӮ№жҳҜз»Ҹеёёз»ҙжҠӨзқҖеӨ§йҮҸиҝһжҺҘпјҢдҪҶе…¶дёӯжҹҗдёҖж—¶еҲ»иҜ»еҶҷзҡ„ж“ҚдҪңз¬Ұж•°йҮҸеҚҙдёҚеӨҡгҖӮepollе…ҲйҖҡиҝҮepoll_ctlжіЁеҶҢдёҖдёӘжҸҸиҝ°з¬ҰеҲ°еҶ…ж ёдёӯпјҢ并дёҖзӣҙз»ҙжҠӨзқҖиҖҢдёҚеғҸpollжҜҸж¬Ўж“ҚдҪңйғҪе°ҶжүҖжңүиҰҒзӣ‘жҺ§зҡ„жҸҸиҝ°з¬Ұдј йҖ’з»ҷеҶ…ж ёпјӣеңЁжҸҸиҝ°з¬ҰиҜ»еҶҷе°ұз»Әж—¶пјҢйҖҡиҝҮеӣһжҺүеҮҪж•°е°ҶиҮӘе·ұеҠ е…Ҙе°ұз»ӘйҳҹеҲ—дёӯпјҢд№ӢеҗҺepoll_waitиҝ”еӣһиҜҘе°ұз»ӘйҳҹеҲ—гҖӮд№ҹе°ұжҳҜиҜҙпјҢepollеҹәжң¬дёҚеҒҡж— з”Ёзҡ„ж“ҚдҪңпјҢж—¶й—ҙеӨҚжқӮеәҰд»…дёҺжҙ»и·ғзҡ„е®ўжҲ·з«Ҝж•°жңүе…іпјҢиҖҢдёҚдјҡйҡҸзқҖжҸҸиҝ°з¬Ұж•°зӣ®зҡ„еўһеҠ иҖҢдёӢйҷҚгҖӮ

epollеңЁдј йҖ’еҶ…ж ёдёҺз”ЁжҲ·з©әй—ҙзҡ„ж¶ҲжҒҜж—¶дҪҝз”ЁдәҶеҶ…еӯҳе…ұдә«пјҢиҖҢдёҚжҳҜеҶ…еӯҳжӢ·иҙқпјҢиҝҷд№ҹдҪҝеҫ—epollзҡ„ж•ҲзҺҮжҜ”pollе’Ңselectжӣҙй«ҳгҖӮ

pollе’ҢepollйҖӮз”ЁдәҺе…іеҝғжҸҸиҝ°з¬ҰдёӘж•°еӨҡзҡ„еә”з”ЁзЁӢеәҸгҖӮе…¶дёӯepollеҜ№дәҺжҜҸж¬ЎеҸӘжңүеҫҲе°‘жҸҸиҝ°з¬Ұе°ұз»ӘеҫҲжңүдјҳеҠҝпјҲйҮҮз”Ёеӣһи°ғжңәеҲ¶зӣ‘жөӢжҸҸиҝ°з¬Ұе°ұз»ӘпјүгҖӮ

з»јдёҠпјҡepollжҳҜдёҠйқўдёүдёӘеҮҪж•°дёӯж•ҲзҺҮжңҖй«ҳзҡ„гҖӮ

е…ҚиҙЈеЈ°жҳҺпјҡжң¬з«ҷеҸ‘еёғзҡ„еҶ…е®№пјҲеӣҫзүҮгҖҒи§Ҷйў‘е’Ңж–Үеӯ—пјүд»ҘеҺҹеҲӣгҖҒиҪ¬иҪҪе’ҢеҲҶдә«дёәдё»пјҢж–Үз« и§ӮзӮ№дёҚд»ЈиЎЁжң¬зҪ‘з«ҷз«ӢеңәпјҢеҰӮжһңж¶үеҸҠдҫөжқғиҜ·иҒ”зі»з«ҷй•ҝйӮ®з®ұпјҡis@yisu.comиҝӣиЎҢдёҫжҠҘпјҢ并жҸҗдҫӣзӣёе…іиҜҒжҚ®пјҢдёҖз»ҸжҹҘе®һпјҢе°Ҷз«ӢеҲ»еҲ йҷӨж¶үе«ҢдҫөжқғеҶ…е®№гҖӮ

жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ