жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ

д»ҠеӨ©е°ұи·ҹеӨ§е®¶иҒҠиҒҠжңүе…іеҲ©з”Ёд»ЈзҗҶIPжҖҺд№Ҳе®һзҺ°дёҖдёӘPythonзҲ¬иҷ«пјҢеҸҜиғҪеҫҲеӨҡдәәйғҪдёҚеӨӘдәҶи§ЈпјҢдёәдәҶи®©еӨ§е®¶жӣҙеҠ дәҶи§ЈпјҢе°Ҹзј–з»ҷеӨ§е®¶жҖ»з»“дәҶд»ҘдёӢеҶ…е®№пјҢеёҢжңӣеӨ§е®¶ж №жҚ®иҝҷзҜҮж–Үз« еҸҜд»ҘжңүжүҖ收иҺ·гҖӮ

иҺ·еҸ– IP

д»ЈзҗҶжұ дҪҝз”Ё Flask жҸҗдҫӣдәҶиҺ·еҸ–зҡ„жҺҘеҸЈпјҡhttp://localhost:5555/random

еҸӘиҰҒи®ҝй—®иҝҷдёӘжҺҘеҸЈеҶҚиҝ”еӣһеҶ…е®№е°ұеҸҜд»ҘжӢҝеҲ° IP дәҶ

Urllib

е…ҲзңӢдёҖдёӢ Urllib зҡ„д»ЈзҗҶи®ҫзҪ®ж–№жі•пјҡ

from urllib.error import URLError

import urllib.request

from urllib.request import ProxyHandler, build_opener

# иҺ·еҸ–IP

ip_response = urllib.request.urlopen("http://localhost:5555/random")

ip = ip_response.read().decode('utf-8')

proxy_handler = ProxyHandler({

'http': 'http://' + ip,

'https': 'https://' + ip

})

opener = build_opener(proxy_handler)

try:

response = opener.open('http://httpbin.org/get')

print(response.read().decode('utf-8'))

except URLError as e:

print(e.reason)иҝҗиЎҢз»“жһңпјҡ

{

"args": {},

"headers": {

"Accept-Encoding": "identity",

"Host": "httpbin.org",

"User-Agent": "Python-urllib/3.7"

},

"origin": "108.61.201.231, 108.61.201.231",

"url": "https://httpbin.org/get"

}Urllib дҪҝз”Ё ProxyHandler и®ҫзҪ®д»ЈзҗҶпјҢеҸӮж•°жҳҜеӯ—е…ёзұ»еһӢпјҢй”®еҗҚдёәеҚҸи®®зұ»еһӢпјҢй”®еҖјжҳҜд»ЈзҗҶпјҢд»ЈзҗҶеүҚйқўйңҖиҰҒеҠ дёҠеҚҸи®®пјҢеҚі http жҲ– httpsпјҢеҪ“иҜ·жұӮзҡ„й“ҫжҺҘжҳҜ http еҚҸи®®зҡ„ж—¶еҖҷпјҢе®ғдјҡи°ғз”Ё http д»ЈзҗҶпјҢеҪ“иҜ·жұӮзҡ„й“ҫжҺҘжҳҜ https еҚҸи®®зҡ„ж—¶еҖҷпјҢе®ғдјҡи°ғз”Ёhttpsд»ЈзҗҶпјҢжүҖд»ҘжӯӨеӨ„з”ҹж•Ҳзҡ„д»ЈзҗҶжҳҜпјҡhttp://108.61.201.231 е’Ң https://108.61.201.231

ProxyHandler еҜ№иұЎеҲӣе»әд№ӢеҗҺпјҢеҶҚеҲ©з”Ё build_opener() ж–№жі•дј е…ҘиҜҘеҜ№иұЎжқҘеҲӣе»әдёҖдёӘ OpenerпјҢиҝҷж ·е°ұзӣёеҪ“дәҺжӯӨ Opener е·Із»Ҹи®ҫзҪ®еҘҪд»ЈзҗҶдәҶпјҢзӣҙжҺҘи°ғз”Ёе®ғзҡ„ open() ж–№жі•еҚіеҸҜдҪҝз”ЁжӯӨд»ЈзҗҶи®ҝй—®й“ҫжҺҘ

Requests

Requests зҡ„д»ЈзҗҶи®ҫзҪ®еҸӘйңҖиҰҒдј е…Ҙ proxies еҸӮж•°пјҡ

import requests

# иҺ·еҸ–IP

ip_response = requests.get("http://localhost:5555/random")

ip = ip_response.text

proxies = {

'http': 'http://' + ip,

'https': 'https://' + ip,

}

try:

response = requests.get('http://httpbin.org/get', proxies=proxies)

print(response.text)

except requests.exceptions.ConnectionError as e:

print('Error', e.args)иҝҗиЎҢз»“жһңпјҡ

{

"args": {},

"headers": {

"Accept": "*/*",

"Accept-Encoding": "gzip, deflate",

"Host": "httpbin.org",

"User-Agent": "python-requests/2.21.0"

},

"origin": "47.90.28.54, 47.90.28.54",

"url": "https://httpbin.org/get"

}Requests еҸӘйңҖиҰҒжһ„йҖ д»ЈзҗҶеӯ—典然еҗҺйҖҡиҝҮ proxies еҸӮж•°еҚіеҸҜи®ҫзҪ®д»ЈзҗҶпјҢжҜ”иҫғз®ҖеҚ•

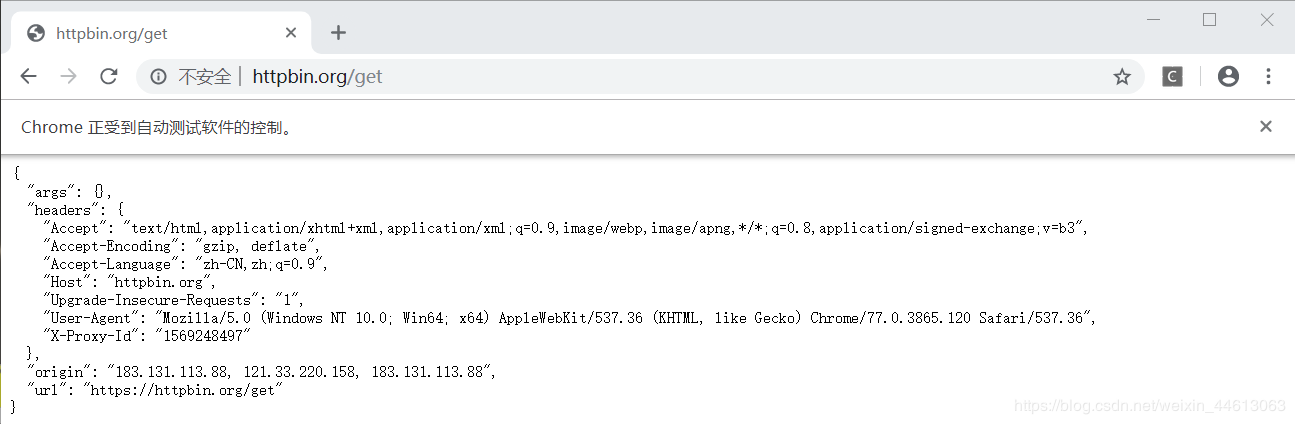

Selenium

import requests

from selenium import webdriver

import time

# еҖҹеҠ©requestsеә“иҺ·еҸ–IP

ip_response = requests.get("http://localhost:5555/random")

ip = ip_response.text

chrome_options = webdriver.ChromeOptions()

chrome_options.add_argument('--proxy-server=http://' + ip)

browser = webdriver.Chrome(chrome_options=chrome_options)

browser.get('http://httpbin.org/get')

time.sleep(5)иҝҗиЎҢз»“жһңпјҡ

зңӢе®ҢдёҠиҝ°еҶ…е®№пјҢдҪ 们еҜ№еҲ©з”Ёд»ЈзҗҶIPжҖҺд№Ҳе®һзҺ°дёҖдёӘPythonзҲ¬иҷ«жңүиҝӣдёҖжӯҘзҡ„дәҶи§Јеҗ—пјҹеҰӮжһңиҝҳжғідәҶи§ЈжӣҙеӨҡзҹҘиҜҶжҲ–иҖ…зӣёе…іеҶ…е®№пјҢиҜ·е…іжіЁдәҝйҖҹдә‘иЎҢдёҡиө„и®Ҝйў‘йҒ“пјҢж„ҹи°ўеӨ§е®¶зҡ„ж”ҜжҢҒгҖӮ

е…ҚиҙЈеЈ°жҳҺпјҡжң¬з«ҷеҸ‘еёғзҡ„еҶ…е®№пјҲеӣҫзүҮгҖҒи§Ҷйў‘е’Ңж–Үеӯ—пјүд»ҘеҺҹеҲӣгҖҒиҪ¬иҪҪе’ҢеҲҶдә«дёәдё»пјҢж–Үз« и§ӮзӮ№дёҚд»ЈиЎЁжң¬зҪ‘з«ҷз«ӢеңәпјҢеҰӮжһңж¶үеҸҠдҫөжқғиҜ·иҒ”зі»з«ҷй•ҝйӮ®з®ұпјҡis@yisu.comиҝӣиЎҢдёҫжҠҘпјҢ并жҸҗдҫӣзӣёе…іиҜҒжҚ®пјҢдёҖз»ҸжҹҘе®һпјҢе°Ҷз«ӢеҲ»еҲ йҷӨж¶үе«ҢдҫөжқғеҶ…е®№гҖӮ

жӮЁеҘҪпјҢзҷ»еҪ•еҗҺжүҚиғҪдёӢи®ўеҚ•е“ҰпјҒ