您好,登录后才能下订单哦!

本篇文章给大家分享的是有关怎么在python中利用Selenium+Requests爬取数据,小编觉得挺实用的,因此分享给大家学习,希望大家阅读完这篇文章后可以有所收获,话不多说,跟着小编一起来看看吧。

python的数据类型:1. 数字类型,包括int(整型)、long(长整型)和float(浮点型)。2.字符串,分别是str类型和unicode类型。3.布尔型,Python布尔类型也是用于逻辑运算,有两个值:True(真)和False(假)。4.列表,列表是Python中使用最频繁的数据类型,集合中可以放任何数据类型。5. 元组,元组用”()”标识,内部元素用逗号隔开。6. 字典,字典是一种键值对的集合。7. 集合,集合是一个无序的、不重复的数据组合。

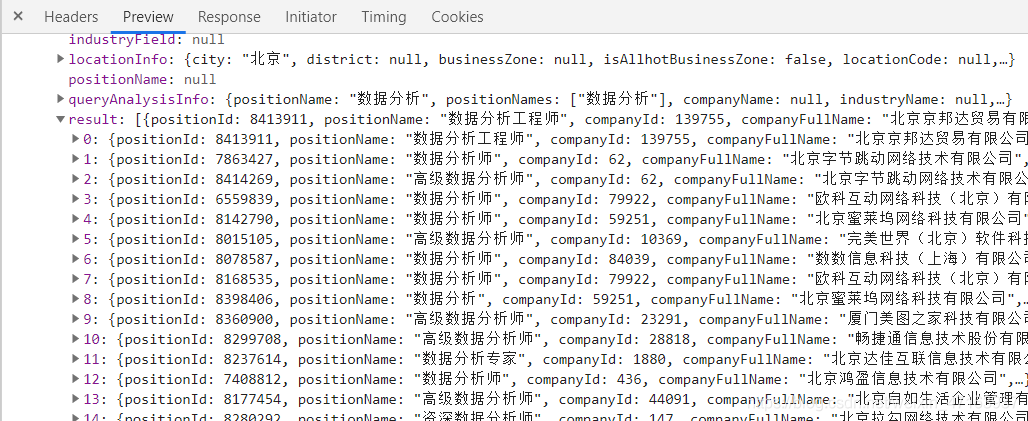

观察页面可知,页面数据属于动态加载 所以现在我们通过抓包工具,获取数据包

观察其url和参数

url="https://www.lagou.com/jobs/positionAjax.json?px=default&needAddtionalResult=false" 参数: city=%E5%8C%97%E4%BA%AC ==》城市 first=true ==》无用 pn=1 ==》页数 kd=%E6%95%B0%E6%8D%AE%E5%88%86%E6%9E%90 ==》商品关键词

所以我们要想实现全站爬取,需要有city和页数

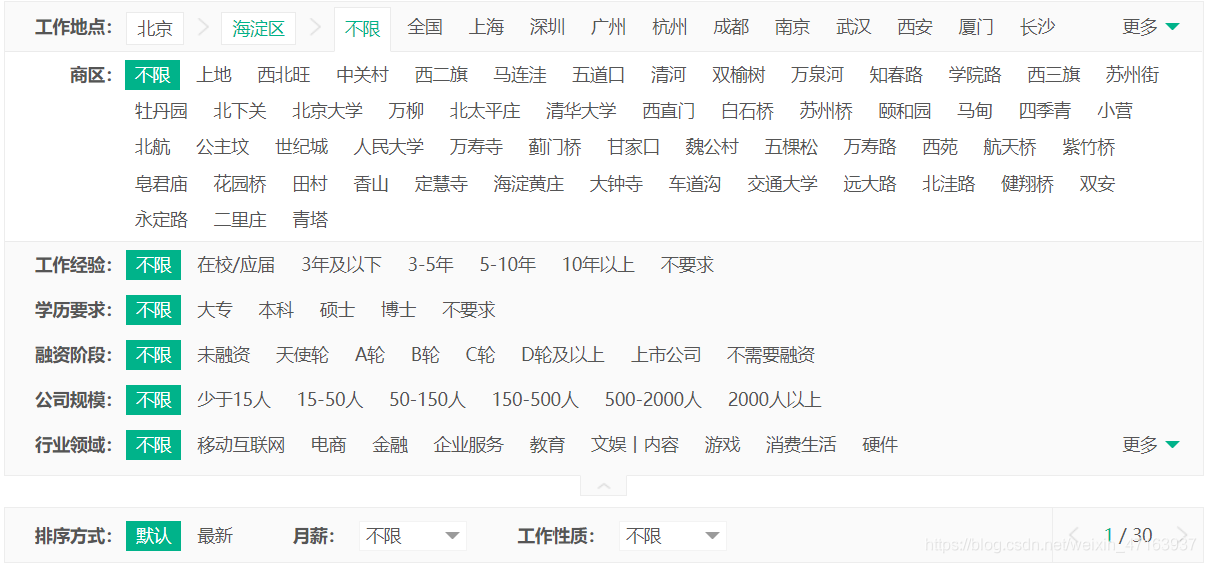

我们打开拉勾网,观察后发现,他的数据并不是完全展示的,比如说 在城市筛选选择全国 仅仅只显示30页 但总页数是远远大于30页的;我又选择北京发现是30页又选择北京下的海淀区又是30页,可能我们无法把数据全部的爬取,但我们可以尽可能的将数据多的爬取

我们为了获取全站数据,必然离不开的有两个参数 一个是城市一个是页数,所以我们利用selenium自动化去获取所有城市和对应页数

def City_Page(self):

City_Page={}

url="https://www.lagou.com/jobs/allCity.html?keyword=%s&px=default&companyNum=0&isCompanySelected=false&labelWords="%(self.keyword)

self.bro.get(url=url)

sleep(30)

print("开始获取城市及其最大页数")

if "验证系统" in self.bro.page_source:

sleep(40)

html = etree.HTML(self.bro.page_source)

city_urls = html.xpath('//table[@class="word_list"]//li/input/@value')

for city_url in city_urls:

try:

self.bro.get(city_url)

if "验证系统" in self.bro.page_source:

sleep(40)

city=self.bro.find_element_by_xpath('//a[@class="current_city current"]').text

page=self.bro.find_element_by_xpath('//span[@class="span totalNum"]').text

City_Page[city]=page

sleep(0.5)

except:

pass

self.bro.quit()

data = json.dumps(City_Page)

with open("city_page.json", 'w', encoding="utf-8")as f:

f.write(data)

return City_Page我们有了每个城市对应的最大页数,就可以生成访问页面所需的参数

def Params_List(self):

with open("city_page.json", "r")as f:

data = json.loads(f.read())

Params_List = []

for a, b in zip(data.keys(), data.values()):

for i in range(1, int(b) + 1):

params = {

'city': a,

'pn': i,

'kd': self.keyword

}

Params_List.append(params)

return Params_List最后我们可以通过添加请求头和使用params url来访问页面获取数据

def Parse_Data(self,params):

url = "https://www.lagou.com/jobs/positionAjax.json?needAddtionalResult=false"

header={

'referer': 'https://www.lagou.com/jobs/list_%E6%95%B0%E6%8D%AE%E5%88%86%E6%9E%90?labelWords=&fromSearch=true&suginput=',

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/89.0.4389.114 Safari/537.36',

'cookie':''

}

try:

text = requests.get(url=url, headers=header, params=params).text

if "频繁" in text:

print("操作频繁,已被发现 当前为第%d个params"%(i))

data=json.loads(text)

result=data["content"]["positionResult"]["result"]

for res in result:

with open(".//lagou1.csv", "a",encoding="utf-8") as f:

writer = csv.DictWriter(f, res.keys())

writer.writerow(res)

sleep(1)

except Exception as e:

print(e)

pass以上就是怎么在python中利用Selenium+Requests爬取数据,小编相信有部分知识点可能是我们日常工作会见到或用到的。希望你能通过这篇文章学到更多知识。更多详情敬请关注亿速云行业资讯频道。

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。