您好,登录后才能下订单哦!

这篇文章主要讲解了“怎么正确使用Scrapy自带的FilesPipeline”,文中的讲解内容简单清晰,易于学习与理解,下面请大家跟着小编的思路慢慢深入,一起来研究和学习“怎么正确使用Scrapy自带的FilesPipeline”吧!

Scrapy自带的 FilesPipeline和ImagesPipeline用来下载图片和文件非常方便,根据它的官方文档[1]说明,我们可以很容易地开启这两个 Pipeline。

如果只是要下载图片,那么用 FilesPipeline 和 ImagesPipeline 都可以,毕竟图片也是文件。但因为使用 ImagesPipeline 要单独安装第三方库 Pillow,所以我们以 FilesPipeline 为例来进行说明。

假设爬虫通过解析网页的源代码,获取到了一张图片,图片的地址为:https://kingname-1257411235.cos.ap-chengdu.myqcloud.com/640.gif 当然,png 、 jpg 、甚至 rar、pdf、zip 都可以。

为了使用 Scrapy 自带的 FilesPipeline来下载这张图片,我们需要做几步设置。

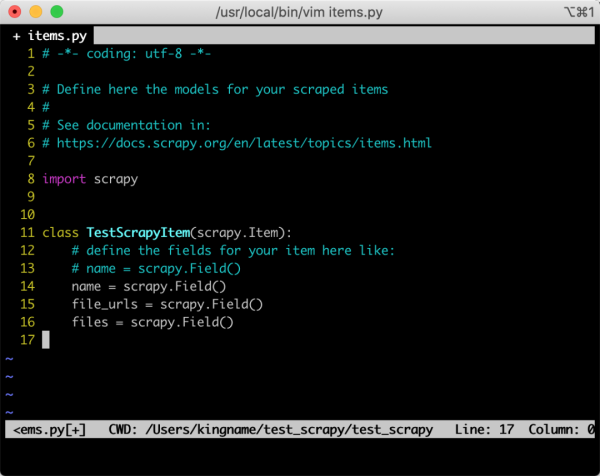

定义 items

首先定义任意一个 items,需要确保这个 items 里面,必须包含file_urls字段和files字段,除了这两个必备字段外,你还可以任意增加其他字段。

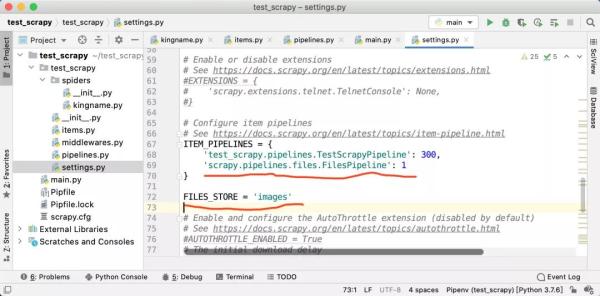

启动FilesPipeline

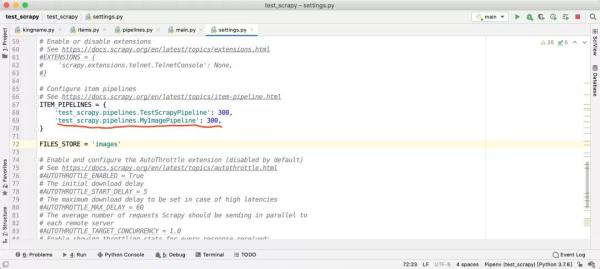

在settings.py中,找到 ITEM_PIPELINES配置,如果它被注释了,那么就解除注释。然后添加如下的配置:

'scrapy.pipelines.files.FilesPipeline': 1

再添加一个配置项FILES_STORE,它的值是你想要保存图片的文件夹地址。

修改以后如下图所示:

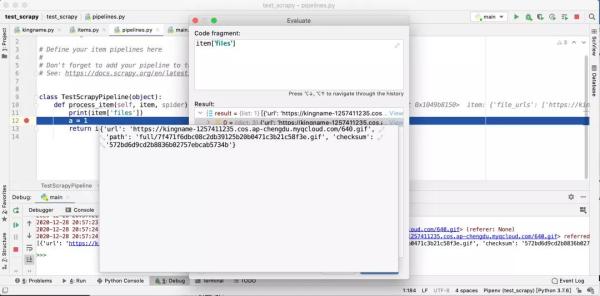

下载图片

接下来,就进入到我们具体的爬虫逻辑中了。在爬虫里面,你在任意一个 parse 函数中提取到了一张或者几张图片的URL 后,把它(们)以列表的形式放入到 item 里面的 file_urls 字段中。如下图所示。

注意,此时files字段不需要设置任何的值。其他非必需字段就根据你的需求只有设置即可。

获取结果

由于我们设置了scrapy.pipelines.images.FilesPipeline的优先级为1,是最高优先级,所以它会比所有其他的 Pipeline 更先运行。于是,我们可以在后面的其他Pipeline 中,检查 item 的 files 字段,就会发现我们需要的图片地址已经在里面了。如下图所示:

item 中的 files 字段变成了一个包含字典的列表。字典中有一项叫做path的 Key,它的值就是图片在电脑上的路径,例如full/7f471f6dbc08c2db39125b20b0471c3b21c58f3e.gif表示在images文件夹中的full文件夹中的7f471f6dbc08c2db39125b20b0471c3b21c58f3e.gif文件,如下图所示:

文件名是该文件的 md5值,如果你想重命名,可以在后续的 pipeline 中,根据 path 的值找到文件,然后修改名字。

修改请求头

看到这里,大家会不会有一个疑问,在使用FilesPipeline的时候,Scrapy 会加上请求头吗?它会用哪一个请求头呢?

实际上,Scrapy 在使用 FilesPipeline和ImagesPipeline时,是不会设置请求头的。如果网站会监控请求图片或者文件的请求的请求头,那么就可以立刻发现这个请求是通过 Scrapy 发起的。

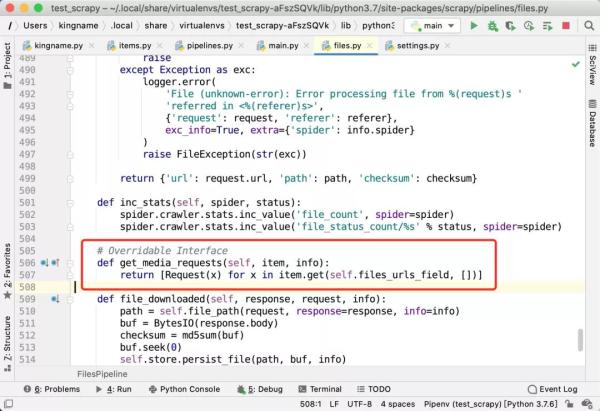

为了证明这一点,我们可以查看FilesPipeline的源代码:

在 scrapy/pipelines/files.py文件中,可以看到,FilesPipeline是通过get_media_requests方法来构造对图片的请求对象的。这个请求对象没有设置任何的请求头。

上面的截图是老版本的 Scrapy 的源代码。新版本的源代码里面,get_media_requests可能是这样的:

def get_media_requests(self, item, info): urls = ItemAdapter(item).get(self.files_urls_field, []) return [Request(u) for u in urls]

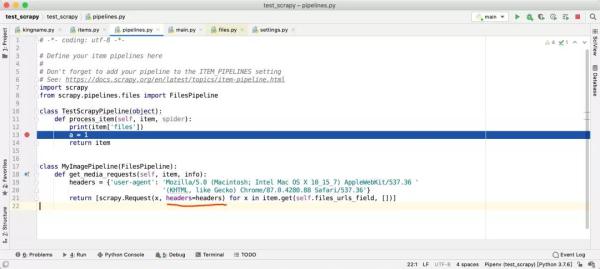

为了手动加上请求头,我们可以自己写一个 pipeline,继承FilesPipeline但覆盖get_media_requests方法,如下图所示:

注意,在实际使用中,你可能还要加上 Host 和 Referer。

然后修改settings.py中的ITEM_PIPELINES,指向我们自定义的这个pipeline:

这样一来,FilesPipeline就能够正确加上请求头了。

感谢各位的阅读,以上就是“怎么正确使用Scrapy自带的FilesPipeline”的内容了,经过本文的学习后,相信大家对怎么正确使用Scrapy自带的FilesPipeline这一问题有了更深刻的体会,具体使用情况还需要大家实践验证。这里是亿速云,小编将为大家推送更多相关知识点的文章,欢迎关注!

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:is@yisu.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。